Токен: скривена цена дијалога са машином

Сећање на 160 карактера

Постоји једна колективна, готово носталгична траума коју дели већина нас који смо, деведесетих и раних двехиљадитих година, користили мобилни телефон. Сећате ли се специфичног менталног напора приликом куцања СМС порука? Имали смо на располагању тачно 160 карактера. Свако слово је имало своју тежину, сваки размак је био трошак, сваку реч смо мерили десет пута и тражили краћу која има слично значење.

Ако бисмо, у намери да будемо језички исправни, написали „Vidimo se večeras“ уместо „Vidimo se veceras“ и употребили слова са квачицама (č, ć, š, ž), порука би прешла са стандардног GSM кодирања на Unicode. У том тренутку лимит поруке пада са 160 на 70 карактера. Резултат? Порука која би без квачица стала у један СМС могла би бити обрачуната као две. У тадашњем свету СМС-а, правопис је био премијум функција.

То је била наша прва лекција из дигиталне економије: оно што је људима смисао, машинама је само низ обрачунских јединица.

Машине не читају, оне рачунају

Данас, док се дивимо способностима генеративне вештачке интелигенције (GenAI) и разговарамо о томе како ће она трансформисати пословање, често заборављамо да у позадини те технологије важе иста, крута правила. Само се терминологија променила. Некада смо бројали карактере, данас бројимо токене.

И управо ту лежи највећи неспоразум између пословног руководства и инжењерске реалности: илузија да машина „чита“ наше документе. Она их не чита. Она их рачуна.

Када питате нешто ChatGPT на српском језику, систем вас не чита онако како ви читате ову реченицу. Он не види слова, не препознаје речи и сигурно не разуме шта значи „разумевање“. Оно што ви доживљавате као дијалог, систем процесира као низове бројева. Та трансформација текста у бројеве почиње јединицом која се назива токен.

Већина корисника ових система, укључујући и многе који их интегришу у пословне процесе, не зна шта је токен, а још мање зашто би требало да их то занима. То незнање није безазлено. Оно директно утиче на перформансе система, трошкове употребе и очекивања која постављате према технологији која, у суштини, не разуме ниједну реч коју напишете или кажете.

Токен није реч. То је први неспоразум који треба рашчистити. ЛЛМ не види латиницу, ћирилицу или било који други алфабет. Он види сегменте текста који су нумерички кодирани и представљени као вектори у вишедимензионалном простору. Токен је управо тај сегмент - део текста који систем препознаје као једну оперативну јединицу.

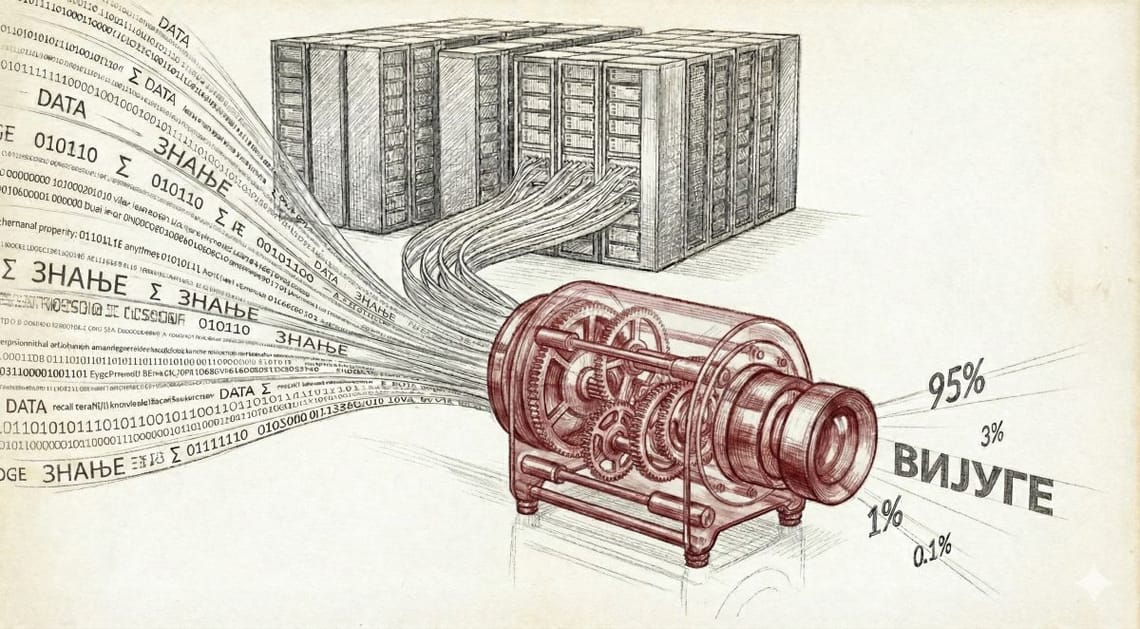

У енглеском језику, токен је често једна реч, понекад део речи или интерпункцијски знак. У српском, због морфологије и деклинација, један токен може бити корен речи, суфикс, префикс или само неколико слова. Однос токен-реч у српском језику је због тога обично неповољнији него у енглеском (приближно 1,6-1,8 токена по речи наспрам 1,2-1,4). Додатно, у зависности од токенизатора, коришћење ћирилице понекад може додатно повећати овај број, што српски језик чини још „скупљим“ у дигиталном простору.

Систем разлаже текст на токене користећи алгоритам који није лингвистички, већ статистички оптимизован на основу огромних корпуса текста током тренирања модела.

Конкретно, реч „разговарате“ може бити један токен или два, у зависности од тога да ли је тај облик био довољно фреквентан у тренинг подацима. Ако јесте, модел га памти као целину. Ако није, разложиће га на „разговара“ и „те“, или на неку другу комбинацију која нема никакве везе са граматиком какву сте учили у школи. Ово није грешка. То је инжењерска одлука. За ЛЛМ језик није систем значења, већ низ мерљивих појава чија се расподела може статистички моделирати.

Управо зато језици са богатом флексијом, попут српског, руског или бугарског, троше више токена него енглески. Систем мора да разгради сложеније форме на више делова да би их уопште могао обрадити. То не значи да AI нужно лоше разуме српски, већ да има мању вероватноћу тачног предвиђања токена у језику који је у тренинг корпусу био мање заступљен.

Зато одговори на српском понекад делују неприродно или механички у моделима као што су Claude, DeepSeek, Kimi и Grok, јер систем саставља реченице токен по токен, не из смисла, већ из образаца које је научио.

Сада, када знамо шта је токен, можемо прецизније формулисати основну функцију ЛЛМ-а и рећи да ЛЛМ не предвиђа следећу реч, већ предвиђа следећи токен.

Архитектура система без памћења

То значи да српски, као улаз, заузима више простора у истом оперативном оквиру. Ту долазимо до кључног ограничења. Сваки позив ЛЛМ-у има буџет токена. Тај буџет није само ваш промпт и одговор модела, већ и цео контекст који систем мора да „држи у глави“: сва претходна питања и одговори, системске инструкције, графикони, слике, приложени документи.

Већина модела данас има ограничење од неколико десетина хиљада до неколико стотина хиљада токена по позиву. То ограничење се зове контекстуални прозор (context window). На папиру то делује издашно, али у пракси врло брзо престаје да буде тако.

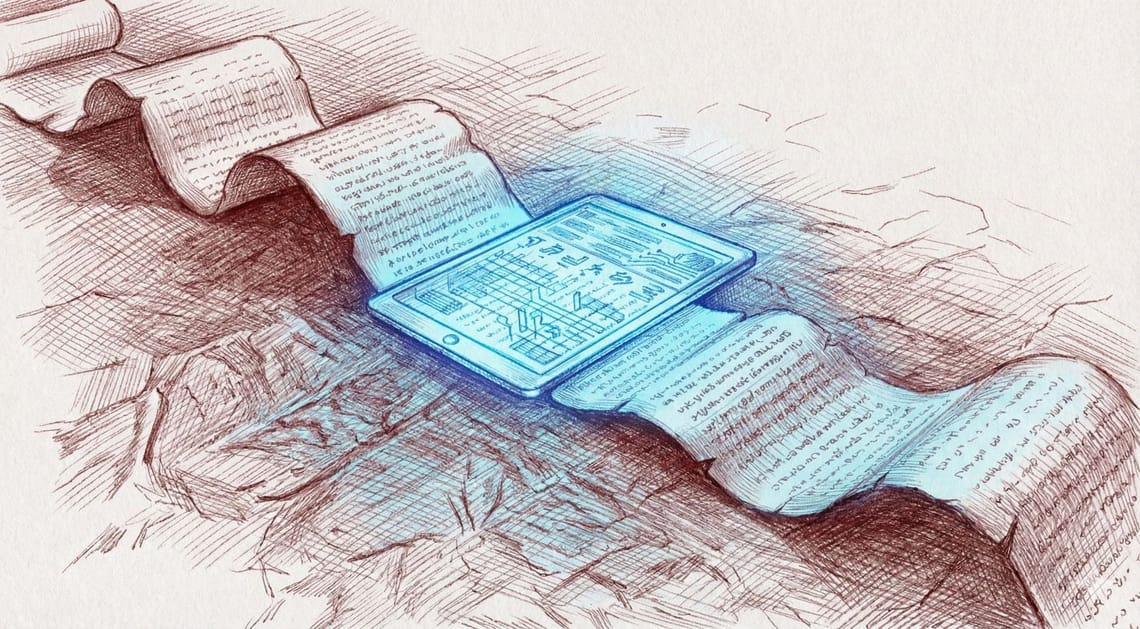

Људи често имају представу да је AI као колега који зна о чему сте причали јуче. Нажалост, стварност је другачија. Сваки нови разговор је нов почетак, осим ако не структурирате процес тако да се контекст одржава. И то није случајна техничка препрека - то је особина саме архитектуре система без трајног унутрашњег стања (stateless). Машина не зна ко сте, о чему сте причали јуче, нити који документ сте јој послали пре недељу дана, осим ако јој те информације поново не пошаљете.

Новији модели, додуше, нуде опцију меморије, тј. систем који аутоматски издваја и чува кључне информације из претходних разговора у посебној бази података ван самог контекстуалног прозора. То делује као решење, али заправо само измешта проблем: систем бира шта ће запамтити на основу статистичких образаца, а не семантичке важности, па нема гаранције да ће запамтити оно што вама заиста треба.

Та меморија се не активира аутоматски, и такође троши токене када се позива и укључује у контекст. Дакле, континуитет може да постоји, али није бесплатан нити поуздан и морате га платити токенима.

Рецимо да желите да ChatGPT анализира записнике са састанака одржаних у претходних шест месеци. Ако је сваки записник дуг три стране, и имате их двадесет, то је 60 страна текста. У просеку, једна страна текста на српском може бити од 400 до 600 речи, што је око 30.000 речи, а то, у зависности од токенизације, може бити и до 50.000 токена само за улаз.

Додајте вашу инструкцију, први одговор и још једну или две итерације питања и одговора, и систем прелази лимит или користи скраћену верзију историје и почиње да „заборавља“ делове контекста, што значи да губи кохерентност. Резултат није драматичан прекид рада, већ површна анализа која делује кохерентно, али је структурно непоуздана. То је најопаснији облик грешке: она коју не примећујете одмах.

Проблем се додатно компликује јер систем не размишља, већ предвиђа следећи токен. Када му је простор за предвиђање ограничен, он не стаје и не сигнализира збуњеност. Он наставља да предвиђа, али на све мањем преосталом простору контекстуалног прозора.

Економија токена

Постоји и економски угао који се често занемарује у случајевима када не користите готове чет-ботове, већ желите да имате свог чет-бота. Већина ЛЛМ API провајдера наплаћује по токену, и то одвојено за улазне и излазне токене. Генерисање одговора је скупље од саме обраде питања, обично четири до осам пута. Ако немате представу колико ваш промпт кошта, немате праву контролу над трошковима.

Многе организације мере употребу ЛЛМ-а бројем позива, а не бројем токена. То је као да потрошњу горива мерите бројем вожњи, а не пређеном километражом и оптерећењем возила. Тада се појављује неочекивани износ на фактури, јер је неко од запослених додао неколико PDF докумената у разговор и поставио двадесет питања, па је сваки позив коштао вишеструко више од просечног.

Ту почиње и друга врста притиска. Када организација одлучи да уведе AI алате, мора да предвиди потрошњу. То није као са осталим пословним софтвером где плаћате фиксну претплату по кориснику. Овде плаћате по интензитету употребе. Неко ко користи AI за повремене консултације троши мало. Неко ко покушава да аутоматизује процесе или да обрађује велике количине података троши много.

И не можете увек унапред знати крајњи трошак, јер он зависи од начина рада, сложености задатака и броја итерација пре него што се добије задовољавајући одговор.

Та слепа тачка организације није техничка, већ управљачка. У већини фирми нико није директно одговоран за токене као ресурс. Они не постоје у табелама и не виде се док се не појави рачун. А када се појави, већ је касно - јер је систем дизајниран око претпоставке да је разговор јефтин и бесконачан. Ипак, он је врло мерљив, ограничен и акумулира трошак.

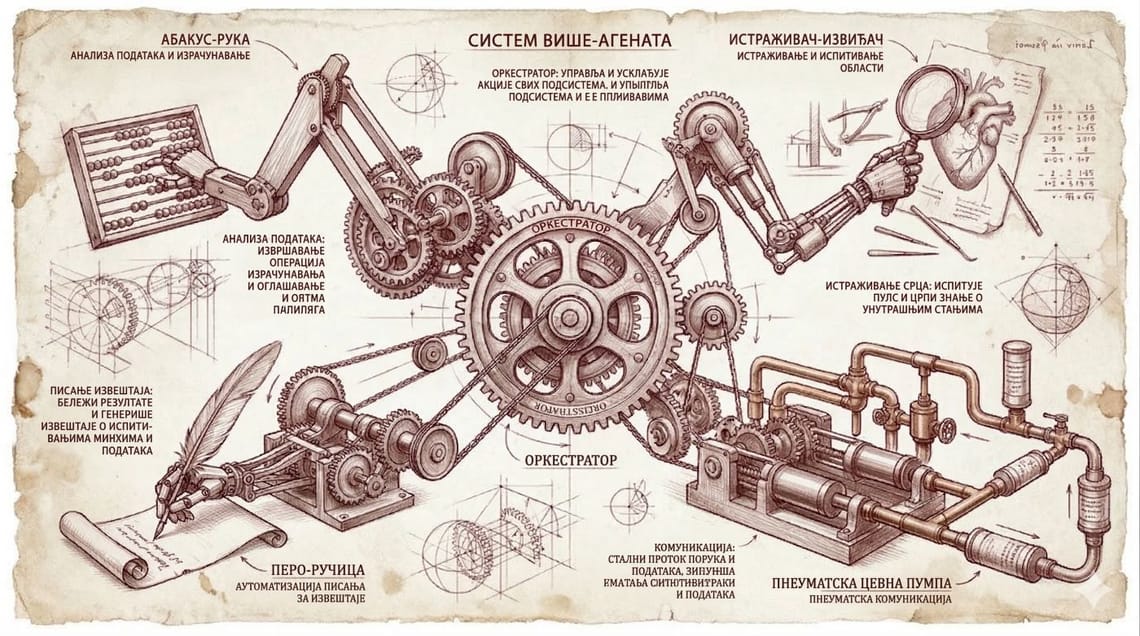

Дисциплина као мера пажње

Оперативно, то значи да управљање токенима није техничка ситница, већ питање процеса. Ко формулише упите? На ком нивоу детаља? Да ли се резимирају претходне дискусије пре него што се настави разговор са системом? Ту на сцену ступа промпт инжењеринг, као дисциплина прецизног превођења пословне намере у формалну структуру упита.

Ту се враћамо на почетну илузију. Када систем одговори брзо и течно, ствара се утисак разумевања. Али тај одговор је резултат статистичког закључивања над токенима које систем заправо никада није прочитао у људском смислу. Ако му дате лоше структуриран промпт или превише комплексан задатак у ограниченом буџету токена, он не схвата да је збуњен. Он производи одговор који је локално конзистентан, али глобално често упитан.

Зато питање није само како да добијемо „бољу вештачку интелигенцију“, већ како да дисциплиновано управљамо интеракцијом. То значи: немојте слати цео документ ако вам треба један пасус; урадите претходну обраду текста; пишите промптове економично и пратите потрошњу токена. Не само због уштеде, већ зато што сваки непотребан токен смањује простор за заиста квалитетан одговор.

Токен није апстрактна техничка јединица. Он је оперативна цена приступа систему, структурално ограничење вашег радног процеса и оквир онога што систем може да уради у једном кораку. Ако не разумете токене, ризикујете да изгубите контролу над алатом који сте управо почели да користите.

У том оквиру, токен је заправо мера пажње система. А пажња, чак и када је дигитална, увек је ограничен ресурс.

Повремено шаљемо мејл када имамо нешто што вреди прочитати.