Престаните да „ћаскате“ са AI-јем ако очекујете озбиљне резултате

Вештачка интелигенција нас није разочарала зато што је „прецењена“, већ зато што смо јој приступили као саговорнику, а не као алату. После почетне еуфорије, остали смо са питким, али празним резултатима, јер смо машини давали инструкције иза којих је стајала нејасна намера и очекивали да AI попуни празнине у нашем размишљању.

AI не разуме контекст, не зна шта је истина и не размишља уместо нас - он само унапреди оно што му дамо. Када то прихватимо, постаје јасно да стварна вредност не долази из „ћаскања“, већ из дисциплине: јасних инструкција, ограничења, система и спремности да чујемо и одговор „не знам“.

Крај илузије разговора

Сећам се периода с краја 2022. године, када бисмо отворили нови прозор за ћаскање, уносили бисмо питање, притискали „Enter“ и чекали, са мешавином стрепње и наде, да се на екрану испише текст који ће нам решити тренутну дилему или дати одговор на неки животни или пословни проблем. Постојала је колективна, прећутна нада да смо коначно пронашли пречицу, да је тешком и спором размишљању дошао крај и да сада имамо дигиталног партнера који нас „разуме“.

Данас, неколико година касније, та еуфорија је углавном спласнула, а на њено место је дошло нешто много тише, али истрајније - фрустрација. Када разговарам са колегама и пријатељима, готово увек чујем исту причу, само упаковану у различите примере и контексте. Кажу ми: „Пробали смо. Делује импресивно на први поглед, али је некако… плитко.“

Добијају текстове који звуче професионално, који су стилски уредни и језички коректни, али који, када се пажљивије прочитају, не говоре ништа конкретно. Добијају планове и стратегије који би, уз минималне измене, могли да се примене на било коју фирму у Србији па и у свету, што у пракси значи да су за њихову конкретну ситуацију готово потпуно бескорисни.

Оно што полако почињемо да схватамо, и то је део који обично највише боли, јесте да смо све време живели са погрешном претпоставком. Веровали смо да је интеракција са генеративном вештачком интелигенцијом (GenAI) разговор. Приписали смо јој људске особине и очекивали да ће она „схватити шта смо хтели да кажемо“ чак и онда када јој нисмо дали јасан контекст.

Међутим, та машина није наш колега. Она нема интерес за остварење наших циљева, нема осећај за хитност, не разуме политичке ни организационе нијансе и, што је можда најважније, она уопште не зна шта је истина. Она зна само шта је вероватно. Она не резонује у категоријама смисла и намере, већ у расподелама вероватноће и статистичким обрасцима који су јој доступни у тренутку генерисања текста.

Тек када се то заиста превазиђе, када постане јасно да не разговарамо са интелигенцијом већ управљамо механизмом вероватноће, почиње прави посао. И тек тада постаје очигледно зашто је толико интеракција са овим системима разочаравајуће: не зато што су алати слаби, већ зато што смо им прилазили са погрешним очекивањима. Све док верујемо да је у питању разговор, већина онога што радимо остаје на нивоу дигиталног ћаскања. Оног тренутка када прихватимо да је реч о алату, а не о саговорнику, постаје јасно и зашто је добар део тог „рада“ заправо био само губљење времена.

Зашто AI природно производи просечност?

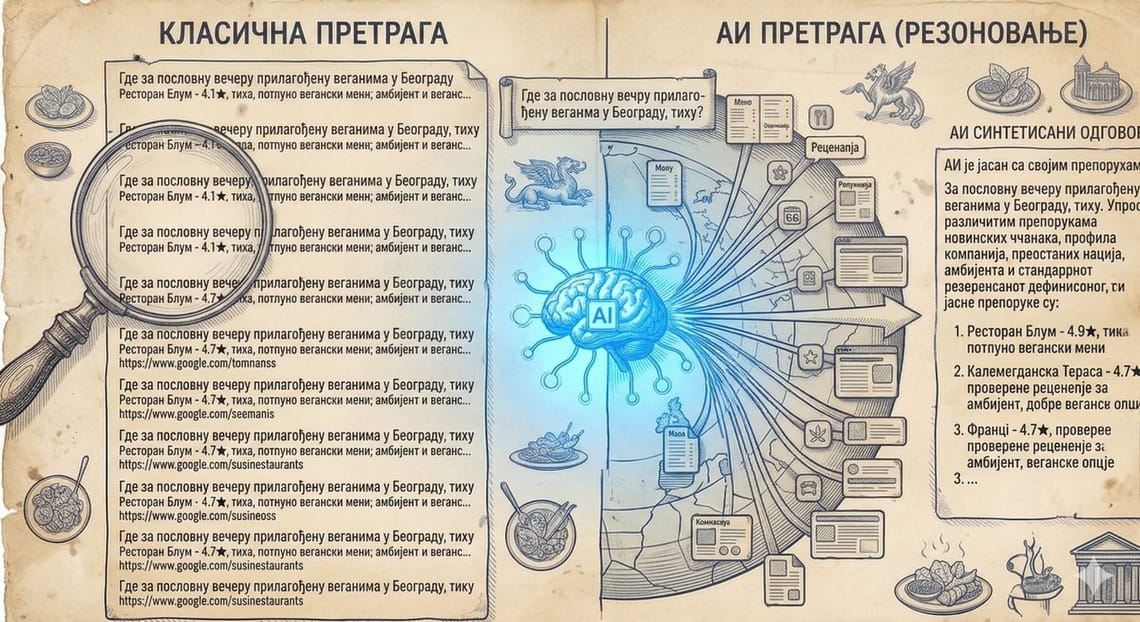

Да бисмо разумели зашто од вештачке интелигенције тако често добијамо такозване „генеричке“ резултате, неопходно је да бар на тренутак погледамо шта се крије иза нашег „саговорника“, како бисмо схватили да су тамо искључиво статистика и вероватноћа. Језички модели, у својој суштини, нису системи који разумеју свет, већ машине за предвиђање следеће речи, трениране и обучене на огромној количини текста који обухвата практично све што је икада написано и што је јавно доступно на интернету.

Када таквој машини поставите једноставан и отворен захтев, на пример: „Напиши ми план продаје за нови производ“, она не почиње да анализира ваше конкретно тржиште, купце, конкуренцију или унутрашња ограничења. Уместо тога, она претражује своје статистичко памћење и тражи образац који се најчешће појављује као одговор на сличне упите. Другим речима, она не тежи оптималном решењу, већ највероватнијем. Она тежи средини. Тежи просеку.

Резултат тог процеса је текст који представља неку врсту „средње вредности“ свих планова продаје који су икада написани, објављени, коментарисани или преписани. Такав текст ће готово увек бити граматички беспрекоран и формално коректан. Имаће увод који звучи уверљиво, разраду која делује систематично и закључак који обећава резултате.

Али управо у томе лежи проблем: он ће бити лишен сваке оштрине, сваке конкретности и сваке специфичности која у реалном пословању прави разлику између стратегије која има вредност за предузеће и оне која нема.

У индустрији се за овакву врсту садржаја појавио помало груб, али прилично прецизан израз - „AI slop“ који представља нискоквалитетни, масовно генерисани AI садржај. Реч је о тексту који попуњава простор, делује као да нешто говори, али у суштини нема опипљиву вредност. Он не прави штету одмах, не садржи очигледне грешке и не изазива аларм, али управо због тога лако пролази као „довољно добар“, иако не носи никакву конкурентску предност.

Ту долазимо до кључног проблема са којим се посебно често сусрећемо у домаћим фирмама. Многе ствари радимо интуитивно, „у ходу“, сматрајући да се одређени контекст, ограничења и циљеви подразумевају сами по себи. Машина, међутим, не подразумева ништа. Она нема осећај за оно што је „очигледно“, нити за оно што „сви знају“. Ако је упит нејасан, резултат неће бити квар система, већ површност и једноличност.

А једноличност је у бизнису често опаснија од очигледне грешке. Грешку приметите, анализирате и исправите. Једноличност, напротив, делује довољно пристојно да „може да прође“, све док се не суочите са последицама одлука донетих на основу садржаја који никада није био довољно прецизан да вам заиста помогне.

Од „ћаскања“ ка моделу размишљања

Сви ови примери нас постепено доводе до закључка да оно што се у јавном дискурсу олако назива „промпт инжењеринг“ нема много везе са вештином лепог формулисања реченица или сналажљивим постављањем питања. У својој суштини, реч је о програмирању природним језиком, односно о способности да се нејасна, често контрадикторна људска намера преведе у јасан и строг скуп инструкција који радикално смањује простор за произвољну интерпретацију.

У практичном раду, то значи напуштање наивног „уноса текста“ и прелазак на структурирани метакогнитивни приступ. Искусни корисници више не формулишу питања у класичном смислу те речи, већ дизајнирају задатке. Они експлицитно дефинишу улогу система, на пример: „понашај се као финансијски аналитичар“ или „анализирај ово као интерни ревизор“, затим уносе релевантан контекст, додају конкретне референце и, можда најважније, постављају јасна ограничења унутар којих модел мора да се креће.

Ево примера из области јавних набавки, где је прецизност пресудна, а грешка може довести до аутоматске дисквалификације или губитка банкарске гаранције. Овде се јасно види разлика између обичног „куцања питања“ и „дизајнирања задатка“.

Контекст: Ваша фирма (ИТ сектор) жели да учествује на комплексном државном тендеру. Имате „Конкурсну документацију“ од 60 страна препуну разних критеријума, правних формулација и техничких захтева.

Наиван приступ (Погрешан циљ - „Напиши ми понуду“):

„Ево ти текст тендера. Напиши ми најбољу понуду на основу конкурсне документације и пропратно писмо тако да имамо најбољу шансу да добијемо овај посао.“

(Проблем: Ово је немогуће. АИ ће написати слаткоречив, али празан текст. Он не може да „победи“ јер не зна вашу цену, рокове, нити има увид у то шта нуди конкуренција. Резултат је бескористан.)

Метакогнитивни приступ (Правилан циљ - „Анализирај услове“):

Овде не тражимо писање текста понуде, већ детаљну анализу услова. Копирајте овај промпт и налепите га у поље за унос питања. Кликните на „+“ и додајте .docx или .pdf фајл који садржи текст тендера, као и сву осталу пратећу документацију, ако је има.

Улога: Делуј као сениор Bid Manager (Менаџер за понуде) са искуством у јавним набавкама у Србији. Твој задатак је да хладнокрвно анализираш документацију и пронађеш разлоге за одустајање.

Контекст: У прилогу је Конкурсна документација. Ми смо ИТ фирма која има квалитетно решење, али не желимо да трошимо време ако су услови намештени или немогући.

Задатак: Анализирај текст и попуни следећу табелу са 5 критичних тачака. За сваку тачку наведи тачан захтев из документације (цитирај) и процени ризик.

1.Финансијска обезбеђења (Ликвидност):

-Колики је износ банкарске гаранције за озбиљност понуде, а колики за добро извршење посла (нпр. 10% од вредности уговора)?

-Да ли се тражи авансна гаранција?

-Који је валутни рок плаћања (нпр. 45 дана)?

2.Пословни капацитет (Референце):

-Колико тачно сличних пројеката морамо имати у последње 3 године?

-Која је минимална вредност тих референтних уговора (нпр. да ли траже да смо већ радили посао вредан 50 милиона, што нас аутоматски избацује)?

3.Кадровски капацитет (Сертификати):

-Које тачно ISO стандарде морамо поседовати (нпр. ISO 27001, 9001)?

-Које специфичне лиценце морају имати инжењери (нпр. лиценце Инжењерске коморе)? Обрати пажњу на необичне или ретке сертификате који указују на фаворизовање одређене фирме.

4.Техничка искључивост (Једини понуђач):

-Да ли спецификација помиње конкретне брендове или произвођаче без додатка „или одговарајуће“?

-Постоје ли захтеви који су превише специфични (нпр. тачне димензије хардвера у милиметар) који одговарају само једном понуђачу?

5.Уговорни ризици (Пенали и Раскид):

-Колики су максимални пенали за кашњење (обично 5-10%, провери да ли је више)?

-Да ли Наручилац задржава право да једнострано раскине уговор и наплати гаранцију ако није „субјективно задовољан“, без објективне арбитраже?

Излаз: Табела са колонама: [Критеријум] | [Захтев из документације] | [Наш статус/Коментар] | [Ризик: НИЗАК/ВИСОК].

Зашто смо навели тачке 2 и 4?

- Тачка 2 (Референце): Ово је у Србији најчешћи филтер. Ако траже да сте већ радили посао исте величине као овај за који конкуришете, то је често „квaка 22“ за мање фирме које желе да расту. AI ово не зна и морамо да му помогнемо да одмах уочи.

- Тачка 4 (Једини понуђач): Ово штеди време техничком тиму. Ако AI пронађе да се тражи процесор који производи само једна компанија на свету, или софтвер који има само један локални дистрибутер, одмах знате да је тендер „цртан“ за неког другог и да не треба трошити ресурсе. AI не зна да треба ово да тражи ако му експлицитно не наведемо.

Управо на овом месту долази до судара са нашом пословном културом. Навикли смо да избегавамо ограничења, да остављамо простор „да видимо шта ће да испадне“, јер ширина често делује као предуслов креативности. У раду са вештачком интелигенцијом, међутим, важи обрнута логика. Ограничења нису сметња, већ предуслов квалитета. Што више сузите простор за маневрисање моделу, то његов излаз постаје фокусиранији, креативнији и употребљивији.

Парадоксално, ако моделу забраните да користи општа места, нејасне претпоставке и спољне изворе, и приморате га да се ослони искључиво на један конкретан PDF документ, на пример интерни правилник или уговор, тај наизглед „глупи“ четбот се трансформише у изузетно прецизан инструмент. У том тренутку престајемо да „ћаскамо“ са машином и почињемо да градимо модел размишљања који служи конкретном пословном циљу.

Контрола тока размишљања: од брзих одговора ка поузданој анализи

Поред нивоа на којем се бавимо формулацијом инструкција и доделом улога, постоји још један, дубљи слој интеракције са вештачком интелигенцијом који се тиче самог начина на који модел долази до одговора, односно начина на који „размишља“.

Савремени језички модели су, по својој природи, „импулсивни“ и оријентисани ка брзини: њихов основни задатак је да што пре понуде одговор, ослањајући се на најјачу статистичку асоцијацију у датом тренутку. Такав приступ често подсећа на студента који диже руку пре него што је професор завршио питање, уверен да већ зна шта се од њега очекује.

Ако нам је циљ да добијемо промишљену анализу или одлуку која може да издржи критичко преиспитивање, та брзоплетост мора бити намерно успорена. Другим речима, потребно је вештачки изазвати процес размишљања и натерати машину да не прескаче кораке.

У стручној литератури ова техника се често назива „ланац мисли“ (Chain of Thought), али је у практичном смислу корисније посматрати је као наметање дисциплине систему који је иначе склон да иде пречицама.

Ево примера који се фокусира на финансијску анализу и процену ризика, што је чест сценарио у домаћем пословању када се разматра нови пословни партнер или добављач.

Уместо ослањања на интуицију или површну проверу, циљ је приморати модел да симулира рад искусног финансијског аналитичара који гледа податке из АПР-а (Агенције за привредне регистре).

Контекст: Домаћа производна фирма разматра потписивање дугорочног уговора са новим купцем. Потребна је процена да ли је тај купац финансијски стабилан.

Лош приступ (Брзоплет/Директан):

„Погледај ове финансијске извештаје фирме 'Х' и реци ми да ли су сигуран партнер за сарадњу.“

(Проблем: Модел ће вероватно дати генерички одговор типа „Фирма изгледа солидно јер има добитак“, занемарујући скривене проблеме попут ликвидности или задужености.)

Дисциплиновани приступ (Ланац мисли / Chain of Thought):

Копирајте овај промпт и налепите га у поље за унос питања. Кликните на „+“ и додајте .pdf фајлове које сте скинули са АПР-а (биланс стања, биланс успеха, токови готовине и напомене уз финансијске извештаје) .

Анализирај достављене финансијске извештаје кроз следеће строго дефинисане кораке. Немој доносити закључак док не прођеш кроз све тачке: 1.Анализа ликвидности: Прво израчунај текући и брзи рацио ликвидности. Упореди однос обртне имовине и краткорочних обавеза. Да ли фирма може да покрије своје обавезе у наредних 12 месеци без продаје залиха? 2.Структура задужености: Изолуј однос сопственог капитала и позајмљених извора. Провери да ли раст пословања финансирају из добити или кроз агресивно задуживање код банака. 3.Квалитет прихода: Анализирај оперативни новчани ток (Cash Flow). Да ли је добитак на папиру резултат реалне продаје или ванредних прихода (нпр. продаје имовине) који се неће поновити? Синтеза: Тек на основу претходна три корака, класификуј ризик сарадње као 'Низак', 'Умерен' или 'Висок' и образложи препоруку.

Зашто ово ради: Оваква структура спречава „халуцинацију“ оптимизма. Тера систем да прво погледа „бројеве“ (ликвидност, дуг), па тек онда формира мишљење. У контексту српске фирме, ово је кључно јер фирма може имати добит на папиру, а бити пред блокадом рачуна - што брзи преглед често пропусти.

Када модел приморамо да експлицитно испише те међукораке, дешава се нешто суштински важно. Сваки корак који машина артикулише постаје сидро за онај следећи, чиме се значајно смањује простор за произвољне скокове у закључивању. Уместо да погађа крајњи резултат на основу општег обрасца, модел је приморан да га изведе логичким следом, корак по корак, што драматично умањује вероватноћу системских грешака.

Тај приступ је веома сличан ономе што наставник ради када дете у математици не пита само за коначно решење, већ инсистира да му покаже цео поступак. Сам резултат може бити тачан и случајно, али је поступак оно што нам даје сигурност да је размишљање исправно. На исти начин, наметање унутрашњег монолога машини није ствар стила, већ механизам контроле квалитета који од брзоплетог асистента прави поуздан аналитички алат.

Вештачки конфликт као алат за боље одлуке

Један од можда најзанимљивијих аспеката зрелог коришћења вештачке интелигенције није у томе да нам она брзо понуди одговор, већ у могућности да је употребимо као алат за тестирање сопствених структурних превида, аналитичких пропуста и неосвешћених претпоставки које уносимо у сваки сложенији процес одлучивања.

Сви смо, у мањој или већој мери, подложни пристрасностима: лако се заљубљујемо у сопствене идеје, тешко нам је да хладно сагледамо мане пројекта који смо сами осмислили, а након што уложимо време и енергију у неки извештај или предлог, критичка дистанца постаје све мања.

У идеалном свету, ту улогу би преузимале колеге које су спремне да укажу на проблеме, али у стварности организација то често не функционише тако. Људи не желе да се замерају, избегавају конфликт или једноставно деле исти начин размишљања, па се критика или не изговори уопште или дође прекасно, када су одлуке већ донете.

Управо у том простору технологија може да преузме улогу коју људи често избегавају - улогу хладног, немилосрдног критичара који нема лични улог у исходу.

Међутим, та улога се не активира аутоматски. По својој подразумеваној поставци, модел је дизајниран да буде љубазан, кооперативан и да потврђује корисникову логику и закључке, јер је обучаван да делује као услужан асистент, а не као неко ко ће систематски рушити ваше аргументе. Ако га оставите без јасних инструкција, он ће вас, у највећем броју случајева, подржати и у ономе што је слабо промишљено.

Зато је неопходно свесно креирати вештачки конфликт. Уместо једног упита и једног одговора, могуће је дизајнирати више различитих особа унутар истог система и доделити им супротстављене циљеве. Једна особа може да наступа из перспективе директора чији је примарни циљ максимална уштеда и минимизација ризика, друга из угла визионара који је спреман да жртвује краткорочну стабилност ради дугорочне иновације, док трећа има задатак да модерира расправу, идентификује аргументе и укаже на тачке неслагања.

У том тренутку више не читате један гладак, генерички одговор, већ пратите транскрипт контролисане свађе. Видите како један део система систематски напада логичке рупе, претпоставке и недоречености у аргументима другог, док модератор покушава да одвоји суштину од реторике. Оваква техника омогућава да своју одлуку сагледате из углова који би вам у класичном, једносмерном размишљању готово сигурно промакли.

Ево примера који илуструје примену методе „Вештачког конфликта“ (Multi-Persona Prompting) у контексту домаће фирме која се налази пред стратешком дилемом везаном за модернизацију. Овај приступ је изузетно користан када одлука није бинарна (добро/лоше), већ захтева балансирање ризика и прилике.

Контекст: Велика домаћа фирма за испоруку брзе поште разматра потпуну аутоматизацију корисничке подршке (увођење AI агената) уместо запошљавања нових оператера у Call центру.

Дизајн промпта: Уместо да питамо: „Да ли да уведемо AI подршку?“, постављамо следећу структуру:

Желим да симулираш дискусију између три стручњака око {ТЕМА} Додели им следеће улоге и нека воде дебату кроз {БРОЈ} круга аргумената:

1.Скептични финансијски директор (CFO): Твој фокус је тренутни 'Cash Flow', очување репутације и неповерење према новим технологијама. Твој главни аргумент је да наши клијенти у Србији желе 'живог човека' и да су грешке (халуцинације) АИ модела правни ризик.

2.Заговорник иновација (CTO): Твој фокус је скалабилност. Тврдиш да људски фактор не може да покрије пикове сезоне без огромних трошкова. Инсистираш да ћемо без АИ изгубити конкурентску предност у наредне 2 године.

3.Објективни стратег (Модератор): Твој посао је да слушаш оба аргумента, тражиш рупе у њиховој логици и на крају предложиш хибридно решење које треба да помири обе стране.

{ТЕМА}: сачекај да корисник унесе своју дилему

{БРОЈ}: сачекај да корисник унесе број

Копирајте претходни промпт и налепите га у поље за унос питања. Модел ће од вас тражити да унесете своју дилему и број кругова дискусије. Промпт можете мењати по потреби тако што ћете мењати број стручњака и њихове улоге. Овакав промпт ће увек генерисати слојевиту анализу коју обичан упит не би дао.

Зашто је ово неопходно? Зато што конверзациони AI системи (ChatGPT, Gemini, Claude, Grok) по својој природи теже да се сагласе са вама. Они су дизајнирани да вам угоде. Ако их не натерате да вам противрече, они ће само елоквентније потврдити вашу заблуду. Овако сте их приморали да сами себи буду „ђавољи адвокат“ и да вам открију структурне превиде, недовољну анализу или погрешне претпоставке које сте произвели.

У ширем смислу, реч је о облику рекурзивног самопобољшања, процесу у којем машина критикује сопствене излазе кроз различите улоге и перспективе све док се не дође до решења које је релативно отпорно на нападе и контра аргументе. Управо зато је овај приступ посебно вредан у нашем окружењу у којем је култура конструктивне критике слаба, па се неслагање често своди или на тишину или на конфликт који брзо прелази на лични ниво, уместо да остане у домену аргумената.

Од појединца ка систему - зашто импровизација не омогућава раст?

У тренутку када ентузијазам око вештачке интелигенције почиње да се претвара у свакодневну праксу, испливава једно суштинско, али често занемарено питање које нема везе са технологијом, већ са организацијом: где се то знање заправо налази и како се унутар предузећа чува.

У реалности већине предузећа, примена AI-ја изгледа прилично неформално и персонализовано. Постоји једна особа - често „Миле из маркетинга“ или „онај дечко из IT-ја“ - за коју сви знају да „уме да ради са ChatGPT-јем“. Он зна шта да пита, како да формулише захтев, како да „извуче“ бољи одговор, и временом се око њега формира утисак да успешно решава проблеме. Фирма користи вештачку интелигенцију, задатак је испуњен.

Проблем је у томе што је целокупно то знање концентрисано у глави једног појединца и у његовој личној историји четовања, која не припада систему, већ налогу. У тренутку када та особа промени тим, предузеће или једноставно престане да се тиме бави, организација не губи само запосленог, већ и акумулирано искуство, логику размишљања и низ малих, али критичних оптимизација упита (промптова) који су се градили методом покушаја и погрешке. Предузеће тада може да се врати корак уназад, а понекад и на сам почетак.

Зрелије организације полако почињу да схватају да промпт није пука реченица коју је неко лепо срочио у датом тренутку. Он представља структурирану инструкцију, формализовано знање и, у суштини, интелектуалну својину. Баш као што постоје интерне процедуре за набавку, продају или управљање људским ресурсима, улазимо у фазу у којој ће бити логично и неопходно да фирме имају сопствене библиотеке промптова.

Те библиотеке не служе као инспирација, већ као инфраструктура. Оне садрже тестиране, верификоване и контекстуализоване језичке алгоритме који обезбеђују да, без обзира на то ко седи за рачунаром - да ли је реч о јуниору који је јуче дошао или о сениору са десет година искуства - резултат који долази од AI алата буде конзистентан, усклађен са тоном компаније и довољно поуздан да може да се користи у реалном пословном процесу.

То је тачка у којој се напушта импровизација и улази у систем, ма колико тај прелаз деловао непопуларно. Разумљиво је зашто код нас постоји отпор према процедурама, јер се оне често доживљавају као бирократски терет који успорава и гуши иницијативу. Међутим, у контексту вештачке интелигенције, процедура није ограничење, већ механизам заштите.

Без стандардизације, AI не постаје паметнији, већ гласнији. Он појачава неорганизованост, недоследност и случајност, уместо да уводи ред. А решавање проблема које зависи од једног човека у ћошку можда делује привлачно, али за озбиљну организацију то представља ризик.

Нова врста ризика: питка, неупадљива грешка

Када говоримо о ризицима вештачке интелигенције, важно је разумети да ти ризици нису статични, већ се мењају и еволуирају упоредо са квалитетом самих модела. Пре годину или две, опасност је била релативно једноставна за идентификацију: модел би „халуцинирао“, измислио правни случај, цитирао непостојећи закон или навео извор који никада није постојао. Такве грешке су биле грубе, видљиве и, у већини случајева, довољно упадљиве да активирају здрав скептицизам корисника.

Данас је ситуација битно другачија. Модели су значајно софистициранији, а самим тим и опаснији у једном суптилнијем, мање очигледном смислу. Грешке нису нестале, али су постале тише, елегантније и теже уочљиве. Уместо очигледне измишљотине, добијамо погрешно протумачену клаузулу уговора која је формално коректна и језички беспрекорна, или финансијску пројекцију у којој постоји мала, али системска грешка у почетној претпоставци која временом производи погрешне закључке.

Проблем је у томе што је такав текст „питак“. Он тече без отпора, звучи уверљиво, делује стручно и самим тим полако спушта наш критички гард. Уместо да преиспитујемо закључке, ми почињемо да верујемо стилу. Елоквенција машине ствара лажни осећај сигурности, а управо у том уљуљкивању лежи највећи ризик, јер грешка више не личи на грешку, већ се понаша као разумна, добро аргументована истина.

Зато је један од кључних елемената зрелог коришћења AI-ја увођење нечега што бисмо могли назвати усклађивањем очекивања. То подразумева да од модела не тражимо само одговоре, већ да му унапред поставимо јасне границе у погледу онога шта сме, а шта не сме да закључи. У пракси, то значи да у инструкцијама морамо експлицитно захтевати да модел каже шта не зна, где нема довољно података и где би иначе био у искушењу да попуни празнине сопственим претпоставкама.

Инструкција типа: „Ако податак није експлицитно наведен у тексту, немој га претпостављати, већ јасно напиши: НЕДОСТАЈЕ ПОДАТАК“ често има већу практичну вредност од хиљаду страница лепо формулисаног, али потенцијално погрешног текста. У бизнису је „не знам“ неупоредиво корисније од уверљиве лажи.

AI као одраз јасноће људског размишљања

Када се, на крају, подвуче црта и одузму технолошки детаљи од стварног искуства, постаје јасно да ова еволуција од једноставних питања ка сложеним когнитивним архитектурама није пре свега прича о напретку машина, већ много више прича о нама самима и о квалитету нашег размишљања.

Вештачка интелигенција, у својој суштини, не делује као мудар саветник нити као замена за људско промишљање, већ као немилосрдно прецизно огледало наше јасноће. Ако не знамо шта тачно желимо да постигнемо, зашто то желимо и по којим критеријумима ћемо процењивати успех, ни најсофистициранији модел на свету не може ту празнину да попуни. Он ће, у том случају, само брже, течније и убедљивије артикулисати нашу конфузију, дајући јој форму која звучи као одговор, иако то суштински није.

Често се може чути да ће AI учинити људе лењима, да ће нам атрофирати способност мишљења и да ћемо се временом ослонити на машине уместо на сопствени разум. Моје искуство, међутим, показује управо супротно. Да би се од ових система добио резултат који има стварну вредност, потребно је размишљати јасније, дисциплинованије и критичније него икада раније. Неопходно је умети да се проблем разложи на саставне делове, да се унапред препознају тачке у којима процес може да скрене у погрешном смеру и да се осмисли структура која води ка смисленом решењу.

То што радимо у интеракцији са AI-јем није пуко „куцање текста“, нити импровизована комуникација са машином. То је кодификација људске намере, превођење мисли, претпоставки и циљева у форму која мора бити довољно јасна да би је систем могао следити. И док год је та намера нејасна, противречна или недовољно промишљена, резултат ће неминовно бити просечан, без обзира на моћ алата који користимо.

Алат се јесте променио и постао неупоредиво снажнији, али одговорност за смисао, контекст и коначну интерпретацију резултата није нестала. Она је, и увек ће бити, искључиво на нама.

Питања за размишљање

Пре него што следећи пут отворите „ChatGPT“ или „Gemini“, или пре него што без много размишљања одобрите буџет за још једну „AI имплементацију“, направитe кратку паузу и поставитe себи неколико непријатних, али неопходних питања. Не као формални тест зрелости, и свакако не као маркетиншку чек-листу, већ као елементарну проверу реалности у којој се налазите:

- Да ли овај задатак препуштам машини зато што је заиста јасно дефинисан, структуриран и по природи се често понавља, или зато што ни сам немам јасан ментални модел проблема, па се потајно надам да ће ми машина „набацити неку идеју“ од које ћу кренути?

- Ако бих потпуно исти скуп инструкција дао новозапосленом који не познаје контекст и не чита између редова, да ли би он тачно разумео шта од њега тражим, или би био приморан да нагађа, импровизује и попуњава празнине сопственим претпоставкама?

- Да ли у оквиру фирме постоји систем који бележи знање, логику одлучивања и проверене начине рада, или се и даље ослањамо на индивидуалце који сваког јутра поново „откривају топлу воду“, сваки на свој начин?

И, можда најнепријатније од свих питања: да ли сам заиста спреман да прихватим, па чак и да активно тражим одговор у којем машина каже „не знам“, указује на недостајуће податке или открива грешке у мом размишљању, или у суштини тражим софистициран механизам који ће ми елоквентно потврдити оно у шта сам већ одлучио да верујем?

Повремено шаљемо мејл када имамо нешто што вреди прочитати.