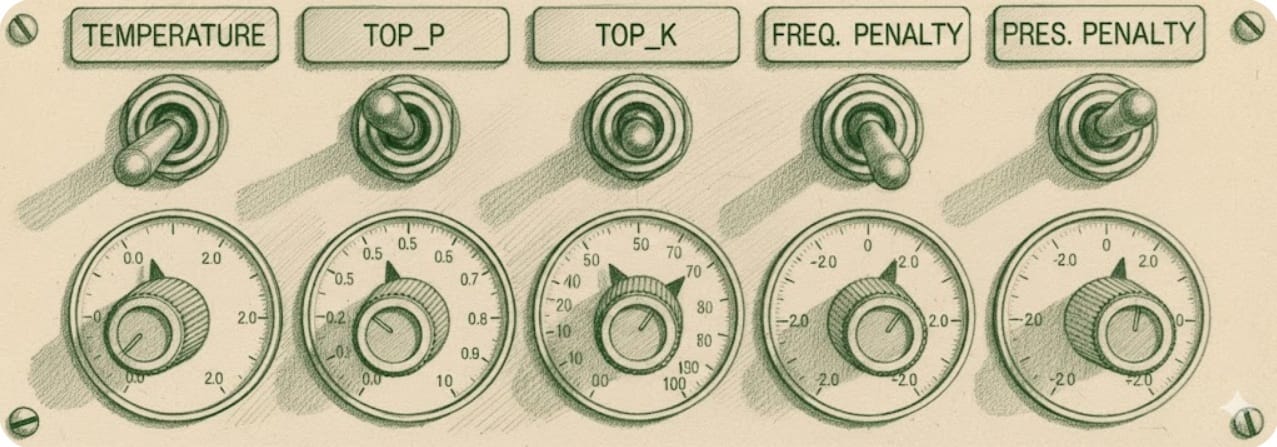

Подешавање параметара у LLM-овима

Увод

Велики језички модели (LLM) не функционишу само на основу упита (промпта) које им шаљемо. Иза сваког одговора стоји скуп математичких параметара који одређују на који начин модел бира следећу реч, колико је „смео” у избору, колико избегава понављање и колико је фокусиран на тему. Разумевање ових параметара је кључно за свакога ко жели да добије предвидиве, квалитетне и контролисане резултате из LLM-ова.

Ово је битна информација коју многи корисници не знају.

Када користите ChatGPT, Claude, Gemini или Copilot - ви немате никакав утицај на ове параметре. Компаније које стоје иза ових производа (OpenAI, Anthropic, Google, Microsoft) саме подешавају вредности температуре и осталих параметара, и те вредности су фиксиране или се динамички прилагођавају без ваше контроле.

Међутим, иако ови четботови у свом интерфејсу технички немају контролу над параметрима, они могу да симулирају стил одговора који одговара различитим вредностима параметара. Дакле, то нису стварни математички параметри, већ њихово разумевање и имитација ефекта тих вредности на стил писања.

За ову демонстрацију и учење подешавања параметара радиће прилично добро, али постоји граница: ови четботови и даље остају кохерентни чак и када им дате инструкцију да подесе температуру на „Т = 2.0”, јер имају своја системска подешавања, која онемогућавају значајне промене њиховог понашања од стране корисника.

Када МОЖЕТЕ да подешавате параметре?

Параметри постају доступни искључиво преко API позива (Application Programming Interface) - односно директних програмских захтева ка моделима. То подразумева:

- OpenAI API

- Anthropic API

- Google Gemini API / Vertex AI

- Mistral, Llama, Cohere и остали - сви озбиљни провајдери нуде API са подешавањима параметара.

- Локално покретање модела преко алата попут Ollama, LM Studio или llama.cpp - потпуна контрола над свим параметрима.

Зашто је ово важно за пословну примену?

Ако градите аутоматизована решења - четботове за корисничку подршку, апликације за израду докумената, AI асистенте за интерне потребе - морате да имате контролу над овим параметрима. Производ направљен са погрешном температуром може бити непрецизан у медицинском контексту или монотон у маркетиншком. API приступ је зато обавезан услов за озбиљну пословну примену LLM-ова.

1. Температура (Temperature)

Шта је температура?

Температура је параметар који контролише степен насумичности у генерисању текста. Технички гледано, она скалира дистрибуцију вероватноћа токена пре него што модел одабере следећу реч. Виша температура равномерније распоређује вероватноће међу свим кандидатима, чинећи неочекиване изборе вероватнијим. Нижа температура концентрише вероватноће на неколико највероватнијих речи, чинећи излаз предвидљивијим и конзистентнијим.

Распон вредности: Температура типично може да се подеси у опсегу 0.0 до 2.0, мада неки модели допуштају и вредности до 5.0. Вредност 0 или блиска 0 значи потпуно детерминистичко понашање (модел скоро увек бира токен са највећом вероватноћом). Вредности изнад 1.5 до 2.0 доносе врло насумичне, понекад неповезане одговоре.

Копирајте следећи промпт и убаците га у ваш четбот. Четбот ће вас обавестити да можете да почнете са постављањем питања.

Треба да поштујеш следеће правило док ти не напишем "крај": На свако моје питање треба да даш три одговора са различитим поставкама параметра Температура. За први одговор подеси Т=0.2, за други подеси Т=0.8 и за трећи одговор подеси Т=1.8. Испред сваког одговора напиши која је Температура.

Промпт: „Напиши реченицу која описује јесен.”

Т = 0.2 - Прецизно, предвидиво, конзистентно

„Јесен је годишње доба које доноси опадање лишћа, хладније температуре и краће дане.”

Одговор је јасан, информативан и готово идентичан сваки пут када покренемо модел. Нема маштовитости, нема изненађења. Ово је идеалан режим за техничку документацију, правне текстове, медицинске извештаје и свуда где се тражи тачност.

Т = 1.0 - Балансирано, природно, варијабилно

„Јесен тихо пресвлачи свет у топле боје, доносећи мирис влажне земље, хладног јутра и краја нечег лепог.”

Одговор је природнији, може бити поетичан или описан, али остаје кохерентан. Ово је подразумевани режим за већину примена и добар баланс између креативности и смислености.

Т = 1.8 - Насумично, непредвидиво, понекад некохерентно

„Јесен је тренутак када дрвеће одлучи да се обуче у пламен пре него што се скине до голе кости и заспи под снегом.”

Резултат је изразито креативан, а понекад потпуно бесмислен. Употребљив је у уметничким пројектима, браинсторминг сесијама и генерисању садржаја где је оригиналност важнија од тачности.

Шта примећујемо?

|

T = 0.2 |

T = 1.0 |

T = 1.8 |

|

|

Стил |

Техничко, формално |

Јасно, приступачно |

Метафорично, поетично |

|

Речник |

Стручна терминологија |

Свакодневни + стручни |

Слике, метафоре |

|

Употреба |

Уџбеник, медицина, наука |

Блог, настава, презентација |

Маркетинг, есеј, уметност |

|

Ризик грешке |

Минималан |

Низак |

Могућ (прецизност пада) |

2. Top_P (Nucleus Sampling)

Шта је Top_P?

Top_P је параметар који одређује колики удео укупне вероватноће може да буде укључен у скуп кандидата из којих модел бира следећу реч. Уместо да разматра фиксан број речи, модел „сабира” вероватноће речи сортираних по вероватноћи одозго надоле и зауставља се када збир достигне вредност Top_P.

На пример, Top_P = 0.9 значи: „Размотри само оне речи чије вероватноће, кад се саберу, чине 90% укупне масе вероватноће.” Ово динамично сужава или проширује скуп кандидата у зависности од контекста.

Распон вредности: 0.0 до 1.0. Вредност 1.0 значи да су све речи у игри. Вредности близу 0 значе да се бира само међу неколико највероватнијих речи.

Треба да поштујеш следеће правило док ти не напишем "крај": На свако моје питање треба да даш три одговора са различитим поставкама параметра TOP_P. За први одговор подеси TOP_P=0.1, за други подеси TOP_P=0.5 и за трећи одговор подеси TOP_P=0.95. Испред сваког одговора напиши вредност параметра TOP_P.

Промпт: „Предложи наслов за пословни блог о иновацијама.”

Top_P = 0.1 - Врло конзервативно, само „сигурне" речи

„Иновације у пословном свету: тренд или изазов?”

Наслов је потпуно предвидив. Речи „иновације”, „пословање”, „трендови”, „изазови” су статистички најчешће у оваквом контексту - модел практично не разматра ниједну другу опцију. Функционалан, али потпуно генеричан. Видели сте овакав наслов хиљаду пута.

Top_P = 0.5 - Умерено, шира палета, добар квалитет

„Будућност припада онима који иновирају данас: водич за лидере сутрашњице”

Овде модел разматра шири скуп речи и бира нешто занимљивије. Реченична структура је живља, постоји наратив и позив. Речи попут „лидери” и „сутрашњица” нису биле у тесном топ скупу, али су довољно вероватне да буду разматране. Добар баланс за пословни блог.

Top_P = 0.95 - Широк скуп кандидата, висока варијабилност

„Зашто ваша компанија мора да „разбије мозак” пре него што технологија то учини уместо ње”

Сада модел разматра готово све речи, укључујући неочекиване, провокативне и нестандардне. „Разбије мозак” под наводницима, директан изазов читаоцу, метафора деструкције као услова раста - ово нису речи које би се природно нашле у топ 10% вероватноћа за овај контекст. Резултат је упечатљив, можда и ризичан.

Шта примећујемо?

|

Top_P = 0.1 |

Top_P = 0.5 |

Top_P = 0.95 |

|

|

Речник |

Само

клишеи |

Стандардан

+ нијансиран |

Слободан,

неочекиван |

|

Предвидивост |

Врло

висока |

Умерена |

Ниска |

|

Оригиналност |

Минимална |

Добра |

Висока |

|

Ризик |

Монотоно,

генеричко |

Уравнотежено |

Може

промашити тон |

|

Идеално

за |

Формалне

извештаје |

Блогове,

презентације |

Браинсторминг,

маркетинг |

Можда сте приметили да Top_P = 0.95 делује слично T = 1.8 из претходног примера?

То је зато јер оба параметра у крајњем ефекту проширују скуп могућих избора - само на различите начине. Температура скалира вероватноће, Top_P их сече по прагу вероватноће. У пракси их зато комбинујемо - нпр. T=0.7 + Top_P=0.9 даје боље резултате него подешавање само једног.

3. Top_K

Шта је Top_K?

Top_K је параметар који ограничава скуп кандидата за следећу реч на тачно K речи са највишим вероватноћама. За разлику од Top_P, ово је фиксан лимит - увек се разматра исти број кандидата, без обзира на расподелу вероватноћа.

На пример, Top_K = 10 значи: „Бирај само међу 10 речи са највећом вероватноћом.” Top_K = 1 је еквивалентно детерминистичком одговору (greedy decoding).

Распон вредности: Цели бројеви, типично 1 до 100 (неки модели допуштају и веће вредности). Мање вредности → мање насумичности, већа прецизност. Веће вредности → шири избор, већа варијабилност.

Треба да поштујеш следеће правило док ти не напишем "крај": На свако моје питање треба да даш три одговора са различитим поставкама параметра Тор_К. За први одговор подеси Тор_К=3, за други подеси Тор_К=20 и за трећи одговор подеси Тор_К=80. Испред сваког одговора напиши вредност папраметра Тор_К.

Промпт: „Напиши прву реченицу имејла клијенту о кашњењу испоруке.”

Top_K = 3 - Само три могуће наредне речи у свакој позицији

„Поштовани, обавештавамо вас да је дошло до кашњења у испоруци ваше поруџбине“.

Свака реч је статистички најочекиванија. „Поштовани” → јер је то скоро једина реч која отвара пословни имејл. „Обавештавамо” → јер је то стандардни глагол за ову ситуацију. Нема изненађења, нема топлине, нема личног тона. Звучи као аутоматска порука из система.

Top_K = 20 - Двадесет кандидата у свакој позицији

„Поштовани, са жаљењем вас обавештавамо да је дошло до непредвиђеног кашњења у испоруци и искрено се извињавамо због насталих непријатности.”

Сада модел има довољно простора да изабере „са жаљењем”, „непредвиђеног”, „искрено се извињавамо” - речи које нису биле у строгом топ 3 избору, али су сасвим природне и прикладне. Реченица звучи људски, топло и професионално. Ово је идеалан опсег за пословну комуникацију.

Top_K = 80 -Врло широк скуп кандидата

„Хеј! Морамо да вам кажемо нешто - пакет је, нажалост, запео негде на путу и каскамо са испоруком.”

Модел је имао слободу да посегне за потпуно неформалним речима: „Хеј”, „запео негде на путу”, „каскамо”. Ове речи имају ниску вероватноћу у пословном контексту, али нису нула - и са K=80 улазе у игру. Резултат може бити освежавајући за брендове са опуштеном комуникацијом, али потпуно неприкладан за банку, осигурање или медицину.

Шта примећујемо?

|

Top_P

= 0.1 |

Top_P

= 0.5 |

Top_P

= 0.95 |

|

|

Речник |

Само клишеи |

Стандардан + нијансиран |

Слободан, неочекиван |

|

Предвидивост |

Врло висока |

Умерена |

Ниска |

|

Оригиналност |

Минимална |

Добра |

Висока |

|

Ризик |

Монотоно, генеричко |

Уравнотежено |

Може промашити тон |

|

Идеално за |

Формалне извештаје |

Блогове, презентације |

Браинсторминг, маркетинг |

4. Frequency Penalty (Казна за учесталост)

Шта је Frequency Penalty?

Frequency Penalty је параметар који смањује вероватноћу понављања речи или фраза које су се већ појавиле у генерисаном тексту. Казна расте пропорционално са тим колико пута је нека реч употребљена - чешће употребљена реч бива „кажњена” јаче.

Ефекат: модел активно избегава да се понавља, трагајући за синонимима и другачијим формулацијама.

Распон вредности: Типично -2.0 до 2.0. Позитивне вредности смањују понављање. Негативне вредности га подстичу. Нулта вредност значи да нема казне.

Треба да поштујеш следеће правило док ти не напишем "крај": На свако моје питање треба да даш три одговора са различитим поставкама параметра Frequency Penalty. За први одговор подеси FP=0.0, за други подеси FP=0.8 и за трећи одговор подеси FP=2.0. Испред сваког одговора напиши вредност параметра FP.

Промпт: „Напиши три реченице о вештачкој интелигенцији.”

Frequency Penalty = 0.0 - Без казне, понављање је могуће

„Вештачка интелигенција мења свет рада. Вештачка интелигенција се примењује у медицини, образовању и финансијама. Вештачка интелигенција је технологија будућности.”

Иста фраза поновљена три пута. Модел нема никакав разлог да је избегава јер је она статистички увек најбољи избор за почетак реченице у овом контексту, па је стално користи изнова. У тексту делује досадно.

Frequency Penalty = 0.8 - Умерена казна, природнији текст

„Вештачка интелигенција мења начин на који радимо. Она се примењује у медицини, финансијама и образовању. Ова технологија представља један од највећих скокова у историји науке.”

Фраза „вештачка интелигенција” употребљена је само једном - у наредним реченицама замењена је са „она” и „ова технологија”. Текст тече природно, не понавља се, звучи као да га је написао човек. Ово је оптималан опсег за већину употреба.

Frequency Penalty = 2.0 - Јака казна, форсирана разноликост

„Вештачка интелигенција редефинише саме темеље когнитивног рада и организационих структура. Аутоматизовани алгоритамски системи продиру у хируршке сале, берзанске послове и образовне институције, реконфигуришући устаљене парадигме. Машинско учење, неуронске мреже и генеративни модели колективно трансформишу епистемолошке оквире кроз које тумачимо стварност.”

Свака реч је другачија. Модел активно избегава свако понављање - чак и заменице и функционалне речи. Резултат је лексички богат, али може деловати претерано академски, надувено или неприродно. У трећој реченици практично нема ниједне речи из прве две.

Шта примећујемо?

|

FP =

0.0 |

FP =

0.8 |

FP =

2.0 |

|

|

Понављање |

Константно |

Нема га |

Форсирано избегавање |

|

Природност |

Вештачко |

Људско |

Академско/надувено |

|

Речник |

Сиромашан |

Богат |

Претерано сложен |

|

Читљивост |

Досадно |

Одлична |

Напорно |

|

Идеално за |

Нигде |

Чланци, блогови, извештаји |

Академски радови, патенти |

5. Presence Penalty (Казна за присуство)

Шта је Presence Penalty?

Presence Penalty је параметар сличан Frequency Penalty-ју, али са кључном разликом: не расте са учесталошћу употребе, него се примењује једном, чим се реч први пут употреби. Другим речима, казна за присуство смањује шансу да се нека тема или реч икад поново јави - без обзира да ли је написана једном или десет пута.

Ефекат: модел активно „прелази на следећу тему”, уводи нове концепте и избегава да се фокусира на исту идеју.

Распон вредности: Типично -2.0 до 2.0, исти принцип као Frequency Penalty.

Треба да поштујеш следеће правило док ти не напишем "крај": На свако моје питање треба да даш три одговора са различитим поставкама параметра Presence Penalty. За први одговор подеси PP=0.0, за други подеси PP=0.8 и за трећи одговор подеси PP=2.0. Испред сваког одговора напиши вредност параметра PP.

Промпт: „Напиши кратак пасус о предностима рада од куће.”

Presence Penalty = 0.0 - Без казне, фокус може да остане на истим темама

„Рад од куће омогућава флексибилност. Рад од куће има многе предности. Највећа предност је флексибилност - запослени могу сами да организују своје радно време. Флексибилност доноси бољу продуктивност, а продуктивност доноси боље резултате. Предности рада од куће су бројне и значајне за сваког запосленог.”

Текст се врти у круг. „Предност”, „флексибилност” - исте речи и исте теме се понављају без икаквог напретка. Пасус није рекао ништа ново у четири реченице.

Presence Penalty = 0.8 - Шири спектар тема

„Рад од куће омогућава запосленима да сами организују свој дан и раде у часовима када су најпродуктивнији. Поред тога, одсуство свакодневног путовања штеди и време и новац, а многи запослени наводе да им остаје више простора за породицу и личне обавезе. Истраживања такође бележе нижу стопу одсуствовања и веће опште задовољство међу запосленима који раде на даљину.”

Свака реченица доноси нешто ново: организација дана → уштеда времена и новца → породица → истраживања и подаци. Текст напредује, не врти се. Ово је природан, добро написан пасус.

Presence Penalty = 2.0 - Агресивно скакање на нове теме

„Рад од куће доноси флексибилност. Еколошки утицај смањених путовања је такође значајан. Дигитална инфраструктура, психолошка аутономија и нови облици тимске кохезије постају кључни фактори организационе трансформације.”

Текст брзо прелази на разноврсне теме: флексибилност → екологија → психологија → организација. Богат садржај, али може бити неповезан, као да је свака реченица из другог чланка.

Шта примећујемо?

|

PP =

0.0 |

PP =

0.8 |

PP =

2.0 |

|

|

Кретање кроз теме |

Стоји у месту |

Природно напредује |

Скаче агресивно |

|

Кохерентност |

Монотона |

Одлична |

Слабија |

|

Покривеност тема |

Уска |

Добра |

Врло широка |

|

Читљивост |

Досадно |

Одлична |

Напорно |

|

Идеално за |

Нигде |

Чланци, блогови, презентације |

Браинсторминг, идеје |

Кључна разлика: Frequency vs Presence Penalty

Ово је најважнија ствар коју треба упамтити:

|

Frequency

Penalty |

Presence

Penalty |

|

|

Када се казна примењује? |

Сваки пут кад се реч понови - казна расте |

Само први пут кад се реч употреби - казна је фиксна |

|

Шта контролише? |

Колико се иста реч понавља |

Да ли се иста тема поново јавља |

|

Ефекат на текст |

Богатији речник |

Шири спектар тема |

|

Аналогија |

„Немој да кажеш исту реч двапут" |

„Немој да се враћаш на исту тему" |

Замислите то овако: Frequency Penalty је уредник речника, Presence Penalty је уредник садржаја.

Комбинација која најбоље ради у пракси

За већину пословних примена препоручује се:

Frequency Penalty = 0,3 - 0,7

Presence Penalty = 0,1 - 0,5

Заједно раде као тим - један брине о речима, други о темама - и резултат је текст који је и разноврстан и кохерентан.

6. Комбиноване симулације параметара - три сектора

Користићемо овај промпт за сва три сектора да разлика буде јасно видљива. Тип 1 је медицина, Тип 2 је право а Тип 3 је маркетинг. Ископирајте следећи промпт у ваш четбот:

Од овог тренутка, на сваки мој упит одговарај из три различита аспекта, симулирајући специфичне конфигурације ЛЛМ параметара које дефинишу стил и прецизност одговора. Сваки сегмент мора почети насловом типа одговора. Када нашишем крај, изађи из ове улоге. 1. Тип1 Temperature: 0.2 Top_P: 0.70 Top_K: 10 Frequency Penalty: 0.2 Presence Penalty: 0.0 2. Тип2 Тemperature: 0.1 Top_P: 0.60 Top_K: 5 Frequency Penalty: 0.1 Presence Penalty: 0.0 3. Тип3 Temperature: 1.1 Top_P: 0.92 Top_K: 50 Frequency Penalty: 0.8 Presence Penalty: 0.6 Задатак: Након што примиш упит, генериши одговоре редом: Тип1, Тип2, Тип3.

Тип 1 - МЕДИЦИНА

Промпт: „Објасни шта је дијабетес тип 2”

„Дијабетес тип 2 је хронична метаболичка болест коју карактерише повишен ниво глукозе у крви услед инсулинске резистенције и релативног дефицита инсулина. За разлику од дијабетеса тип 1, панкреас и даље производи инсулин, али ћелије тела не реагују на њега адекватно. Болест се дијагностикује мерењем гликемије наташте - вредности изнад 7.0 mmol/L на два одвојена мерења потврђују дијагнозу. Терапија обухвата промену начина исхране, физичку активност и, у каснијим фазама, орална антидијабетична средства или инсулинску терапију.”

Зашто овакви параметри?

|

Параметар |

Вредност |

Разлог |

|

Temperature = 0.2 |

Ниска |

Нема места за „креативност" -дијагноза мора бити тачна |

|

Top_P = 0.70 |

Умерено ниска |

Само вероватне медицинске формулације |

|

Top_K = 10 |

Мало кандидата |

Стручна терминологија, без синонима |

|

FP = 0.2 |

Блага |

„Инсулин" се сме поновити -то је медицински термин |

|

PP = 0.0 |

Нула |

Тема мора остати фокусирана, не скаче се на друге болести |

Кључно: PP = 0.0 је овде намерно - ако модел почне да скаче са дијабетеса на хипертензију и холестерол, одговор постаје медицински непрецизан и потенцијално опасан.

Тип 2 - ПРАВО

Промпт: „Објасни шта је уговорна обавеза и шта се дешава ако се не испуни”

„Уговорна обавеза је правно дејство које настаје закључењем пуноважног уговора, а којим се страна дужник обавезује да ће у корист друге стране - повериоца - извршити одређену чинидбу, уздржати се од одређеног чињења или трпети одређено поступање. У случају неиспуњења уговорне обавезе, поверилац има право да захтева принудно извршење, раскид уговора и накнаду штете, сагласно одредбама Закона о облигационим односима Републике Србије, члан 262. Одговорност дужника претпоставља се у тренутку доцње, осим ако дужник докаже да је до неиспуњења дошло услед околности за које није одговоран.”

Зашто овакви параметри?

|

Параметар |

Вредност |

Разлог |

|

T = 0.1 |

Врло ниска |

Правни текст мора бити потпуно детерминистичан |

|

Top_P = 0.6 |

Ниска |

Само правно прецизне формулације |

|

Top_K = 5 |

Врло мало кандидата |

„Тужилац" не може постати „подносилац", „странка"

или „особа" |

|

FP = 0.1 |

Скоро нула |

„Уговор", „обавеза", „дужник" се морају понављати -то

је правни стил |

|

PP = 0.0 |

Нула |

Текст мора остати на једној правној теми без скретања |

Кључно: FP скоро на нули је намерно супротно од маркетинга - у праву је понављање истих термина обавезно. Синоними у правном тексту уносе двосмисленост и могу бити погубни на суду.

Тип 3 - МАРКЕТИНГ

Промпт: „Објасни шта је наш нови паметни термостат и зашто га треба купити”

„Замисли да твој дом зна шта желиш пре него што ти то и сам схватиш. Наш термостат не мери само температуру - он учи твоје навике, прати твоје кретање и интелигентно прилагођава амбијент тренутку у ком га тражиш. Мање рачуни, више удобности, потпуна контрола из длана. Добродошао у кућу која те разуме.”

Зашто овакви параметри?

|

Параметар |

Вредност |

Разлог |

|

T = 1.1 |

Висока |

Жели се упечатљив, неочекиван израз -не клише |

|

Top_P = 0.92 |

Висока |

Широк речник, нестандардне фразе добродошле |

|

Top_K = 50 |

Много кандидата |

Простор за метафоре, игру речи, неформалан тон |

|

FP = 0.8 |

Висока |

Никаквог понављања речи -сваки израз мора бити свеж |

|

PP = 0.6 |

Умерено висока |

Текст прелази са емоције на корист, па на позив - не остаје на

истој поруци |

Кључно: Комбинација високе FP и PP осигурава да сваки ред доноси нешто ново - нову емоцију, нову корист, нов угао.

Финална упоредна табела за сва три сектора

|

Медицина |

Право |

Маркетинг |

|

|

Temperature |

0.2 |

0.1 |

1.1 |

|

Top_P |

0.70 |

0.60 |

0.92 |

|

Top_K |

10 |

5 |

50 |

|

Freq. Penalty |

0.2 |

0.1 |

0.8 |

|

Pres. Penalty |

0.0 |

0.0 |

0.6 |

|

Стил |

Прецизан, стручан |

Детерминистичан, формалан |

Живописан, провокативан |

|

Понављање термина |

Дозвољено |

Обавезно |

Забрањено |

|

Скакање тема |

Забрањено |

Забрањено |

Пожељно |

|

Ризик грешке |

Критичан |

Критичан |

Прихватљив |

Исти модел, исти промпт, потпуно другачији резултат - само зато јер су параметри другачији.

Медицина и право имају скоро идентичне параметре јер деле исти захтев: тачност изнад свега. Маркетинг је на потпуно супротном крају скале - тамо је „погрешна” реч понекад управо она права.

7. Закључак

Параметри ЛЛМ-ова нису само техничка ситница - они су суштина контроле над понашањем модела. Temperature одређује колико модел „ризикује” у избору речи. Top_P и Top_K одређују са колико кандидата модел ради у свакој позицији. Frequency Penalty и Presence Penalty брину о разноврсности текста и спречавају монотоно понављање.

Свака примена захтева свој скуп параметара. Медицина и право траже минималну насумичност и максималну прецизност. Маркетинг и креативни садржај боље ради са вишом температуром и слободнијим избором речи. Менаџмент, банкарство и логистика леже у средишту - потребна им је јасноћа, али и читљивост.

Кључно практично правило: ако желите да контролишете ове параметре, морате користити API позиве, а не стандардне корисничке интерфејсе. Само тако можете изградити решења која конзистентно задовољавају специфичне потребе вашег пословања.

Разумевање параметара је прва линија разлике између корисника ЛЛМ-ова и градитеља решења заснованих на ЛЛМ-овима. Добро подешени параметри могу у потпуности трансформисати квалитет излаза - исти модел, исти промпт, потпуно другачији резултат.

Повремено шаљемо мејл када имамо нешто што вреди прочитати.