Модел за резоновање (Reasoning model)

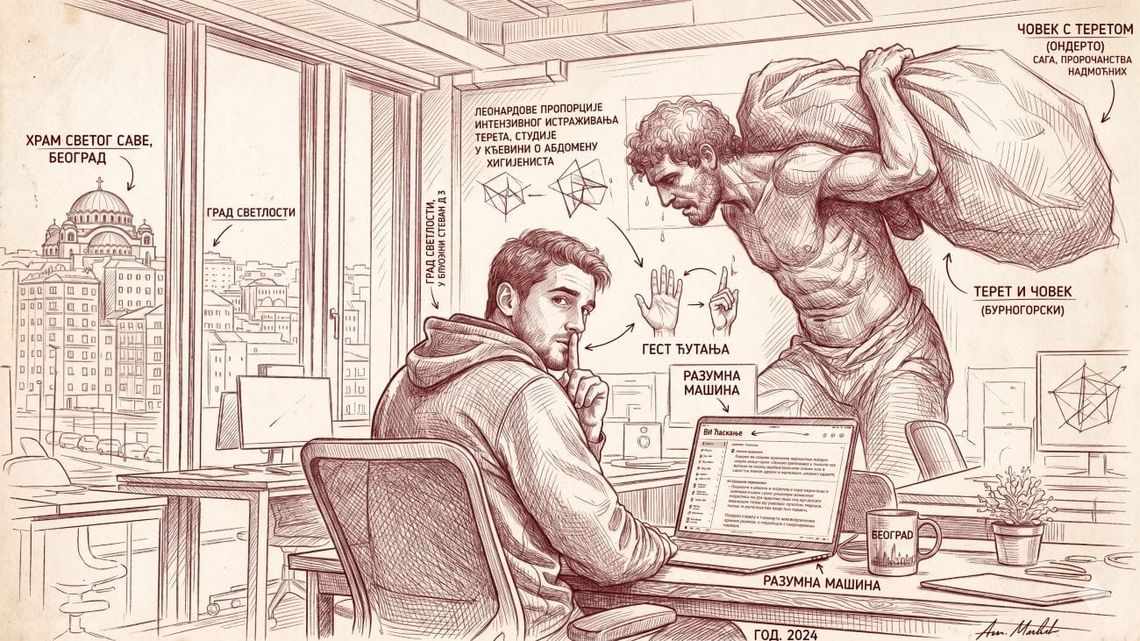

У уторак, 21. априла, мало пре поднева, Јелена, запослена у једној београдској компанији која развија софтвер за осигуравајућа друштва, поставила је моделу генеративне вештачке интелигенције (GenAI) наизглед тривијалан задатак: да из табеле са 1.200 полиса извуче оне код којих се преклапају периоди покрића, а потом да предложи логику за аутоматско упозорење. Модел је одговорио за двадесет секунди. Одговор је био тачан, али оно што је Јелену заиста изненадило није била брзина, већ нешто друго. То је био дугачак, видљив текст који је модел приказао пре финалног одговора, као да разговара сам са собом:

«Корак један: треба да разумем шта значи преклапање датума»

«Корак два: треба да дефинишем граничне случајеве»

«Корак три: напиши псеудокод»

«Корак четири: провери псеудокод на једном измишљеном примеру»

И тек онда је дао одговор.

Овај исти образац се појављује на сасвим различитим местима: у лабораторијама за математичко резоновање, у стартапима који раде на медицинској дијагностици, у истраживачким тимовима који мере колико добро вештачка интелигенција решава задатке из физике. Ови модели не одговарају одмах, већ најпре граде видљив низ међукорака, и постижу резултате који су до пре две године били изван домашаја AI-ја. Овај образац има своје име: AI модел за резоновање (Reasoning model).

Шта се дешава пре одговора?

Модел за резоновање је велики језички модел (LLM) који, пре него што прикаже коначан одговор, генерише експлицитан ток размишљања и серију међурезултата који воде од проблема до решења. У пракси, то не значи да модел заиста „размишља“ онако како то чини човек. То само значи да је трениран или наведен да симулира структуру размишљања, корак по корак, уместо да одмах донесе закључак. У том смислу, кључна разлика није у величини модела нити у количини података на којима је обучен, већ у томе шта ради између питања и одговора, у оном међупростору где се, код класичних модела, не дешава ништа видљиво.

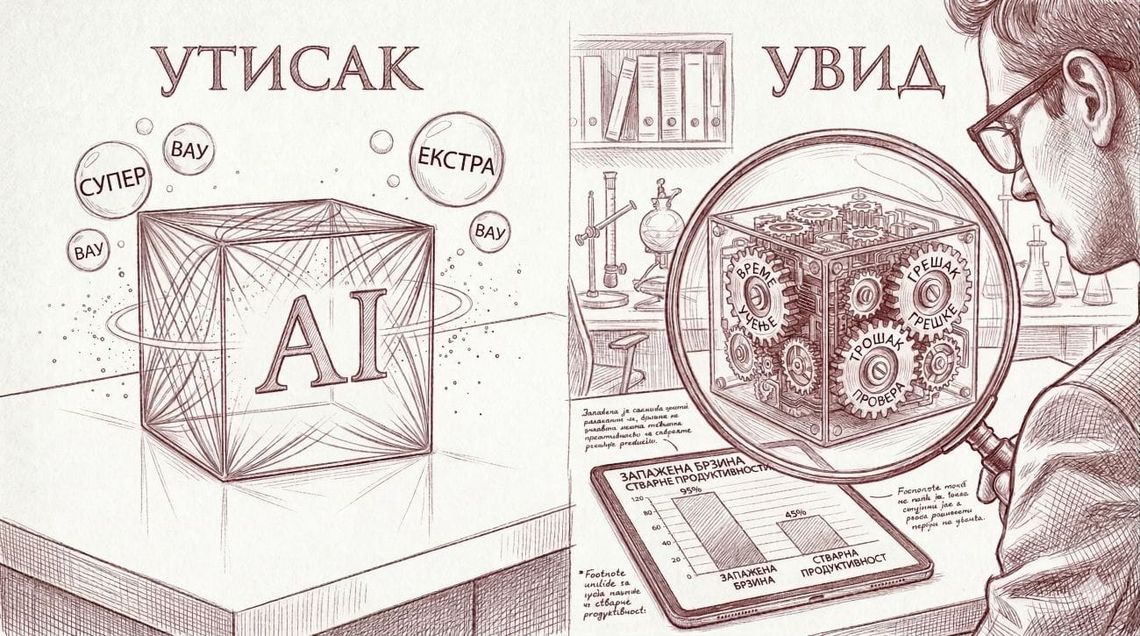

Сва четири водећа четбот интерфејса: ChatGPT (OpenAI), Gemini (Google), Claude (Anthropic) и Grok (xAI), у свом корисничком окружењу нуде подешавање које омогућава бирање између режима рада. Пре него што поставите питање, можете одабрати опције попут брзог одговора (Fast), режима размишљања (Thinking) или продуженог размишљања (Extended thinking).

Брзи режим даје одговор готово тренутно, без видљивих међукорака, што је случај како су класични модели одувек радили. Режим размишљања активира управо оно што је Јелена видела: модел најпре гради експлицитан низ међукорака, а тек потом формулише коначан одговор. Продужено размишљање иде корак даље, где модел проводи још више времена у том међупростору, разматрање је дубље, ланац корака дужи, а резултат је по правилу прецизнији, и то код веома сложених задатака. Другим речима, сада имате директну контролу над тим колико дуго и колико темељно модел „размишља“ пре него што вам одговори, и ова контрола, сама по себи, мења начин на који користите алат.

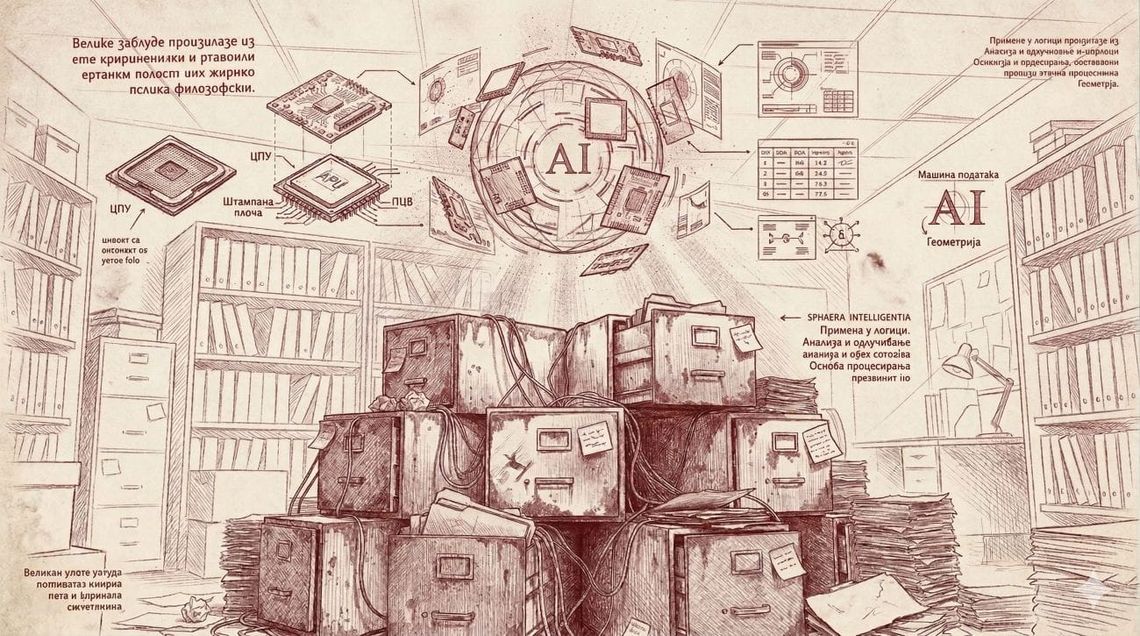

Архитектура поступности

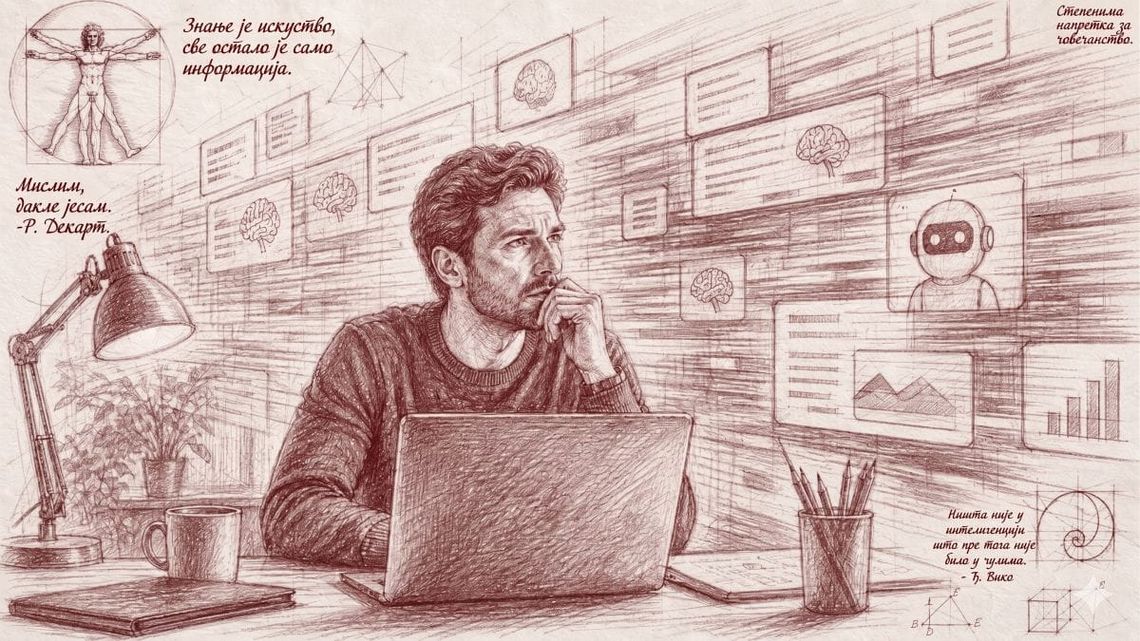

Како све ово у ствари функционише? Када модел за резоновање добије питање, рецимо алгебарски проблем са две непознате, он приказује низ реченица које рашчлањују проблем: идентификује шта је дато, шта се тражи, коју методу да примени, где може да погреши. Сваки корак поставља основу за следећи. Другим речима: модел почиње да „мисли“ пишући текст.

У готово свим доменима где је тачност мерљива, као што су: математика, формална логика, програмирање, па чак и медицинска диференцијална дијагностика, модели са експлицитним током резоновања стално надмашују моделе једнаке величине који одговарају „у једном потезу“. Разлика износи двадесет, тридесет, понекад и четрдесет процентних поена. То је врста побољшања која се у индустрији не виђа често и која тера људе да поново промисле шта је уско грло код језичких модела: да ли је то знање или је то способност да се знањем управља.

Модели за резоновање су толико занимљиви за проучавање јер они додају једну нову структуру у процес. Модел који резонује и модел који не резонује могу имати идентичне параметре, идентичне податке за обуку и идентичну архитектуру. Разлика је само у томе да ли модел себи даје времена и простора да „размисли“ пре него што нам да одговор.

Дакле, где све можемо да видимо овај принцип на делу?

Један истраживачки тим у Цириху пустио је модел за резоновање да решава задатке са такмичења из комбинаторике; задатке на којима су класични велики модели редовно били неуспешни. Са ланцем резоновања, модел је успешно решио четири од шест задатака, укључујући један који захтева доказ индукцијом.

Други случај: стартап у Токију користи сличан приступ за тријажу радиолошких снимака. Модел најпре наводи шта на снимку види, затим искључује дијагнозе једну по једну, и тек на крају предлаже налаз.

Трећи пример долази из сфере права: пилот-пројекат једне канцеларије у Скопљу тестира модел који, пре него што предложи правну квалификацију, исписује анализу релевантних чланова закона, идентификује сукобе норми и рангира аргументе по снази.

Четврти пример, можда најзанимљивији, тиче се образовања: на једном универзитету у Сеулу, студенти користе модел за резоновање да би читали ланац резоновања и уочили где је модел евентуално направио грешку у давању одговора на испитна питања. Дакле, модел служи као партнер за вежбање критичког мишљења.

Пети пример је посебно важан: аналитичар у једној осигуравајућој кући у Минхену користи приступ са резоновањем како би модел могао да објасни зашто је клијентов захтев одбијен. Није довољно да модел донесе одлуку, већ и да прикаже путању закључивања која је до те одлуке довела. Посматрано кроз призму ЕУ Акта о AI, то се може повезати са захтевима за транспарентност, техничку документацију и праћење рада система, односно са потребом да одлука буде разумљива и подложна накнадној провери и ревизији.

У пет различитих области: математика, медицина, право, образовање и осигурање, образац је увек исти. Ако уведемо експлицитне међукораке, тада тачност почиње да расте, објашњивост поступка расте и на крају поверење корисника расте. „Тестирај, понови, прилагоди“, је формула која се из инжењерске праксе сада пресликала на само понашање модела.

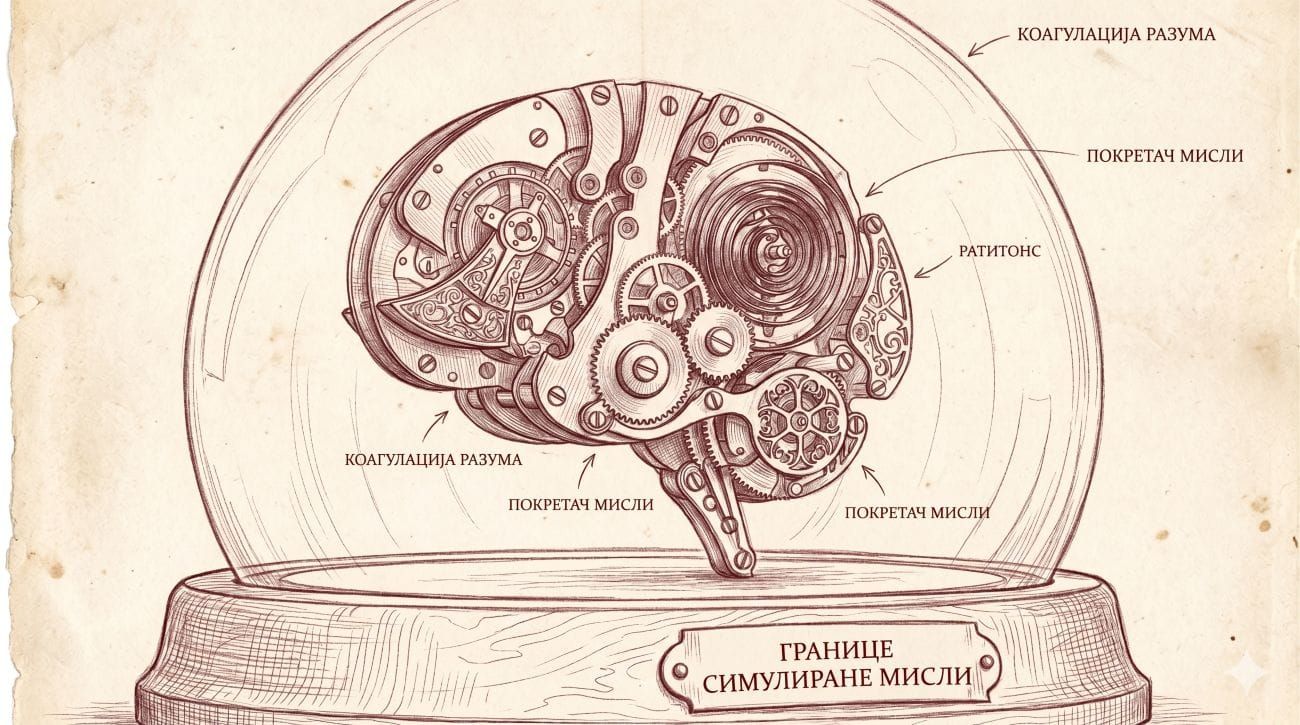

Границе симулације

Ипак, хајде да видимо колико далеко овај принцип може да досегне? Да ли је ланац резоновања универзално решење за све?

Модели за резоновање показују слаб учинак, а понекад чак и пад перформанси, код задатака који су интуитивни или засновани на препознавању образаца без јасне декомпозиције. На пример, класификација сентимента кратких реченица: „Да ли је овај твит позитиван или негативан?“, не добија много од ланца резоновања. Модел који „размишља наглас“ о дванаест речи често се запетља у непотребним разликама и произведе одговор који је спорији, али не нужно и прецизнији.

Исто важи и за задатке где је одговор једнозначан: препознавање језика, основни превод честих фраза, једноставно чињенично претраживање, лакши логички проблеми. Ту је експлицитно размишљање не само непотребно, него и контрапродуктивно. Према томе, видимо да постоје проблеми код којих „размишљање“ модела за резоновање не помаже јер такви проблеми немају структуру која се може разложити.

Граница коришћења ових модела открива нешто важно о самој природи резоновања, и о природи интелигенције уопште. Модели нису бољи зато што „знају више“, већ зато што имају простор да организују оно што већ знају. Тај простор, тај низ текста који се исписује између питања и одговора, функционише као нека врста потпорне скеле или подупирача. Када се скела уклони, остаје одговор чији квалитет носи траг процеса који га је створио. И ми боље решавамо сложене проблеме када размишљамо користећи оловку и папир, него када покушавамо да држимо све у глави.

За сада, ово изгледа као један од најпродуктивнијих праваца у развоју вештачке интелигенције: не треба правити моделе који знају више, него моделе који боље рукују оним што знају. Индустрија AI-ја то полако препознаје. Ресурси који су годинама улагани искључиво у повећање броја параметара сада се делимично преусмеравају на креирање процеса, а не само на креирање знања.

Ови модели нас подсећају на чињеницу да сирова процесорска моћ и огромна количина података имају своје границе. Сада смо научили машину да „размисли“ пре него што нам одговори. То што алгоритам сада може да испише уверљив ток мисли не значи нужно да је суштински разумео проблем, већ само да је научио да боље симулира нашу логику. Ипак, чак и као пука симулација, овај међупростор нам је понудио нешто драгоцено: технологију која је постала кориснија тек када смо јој дозволили да успори.

Повремено шаљемо мејл када имамо нешто што вреди прочитати.