Зашто ниједна техника промптовања не може да замени ваше вијуге

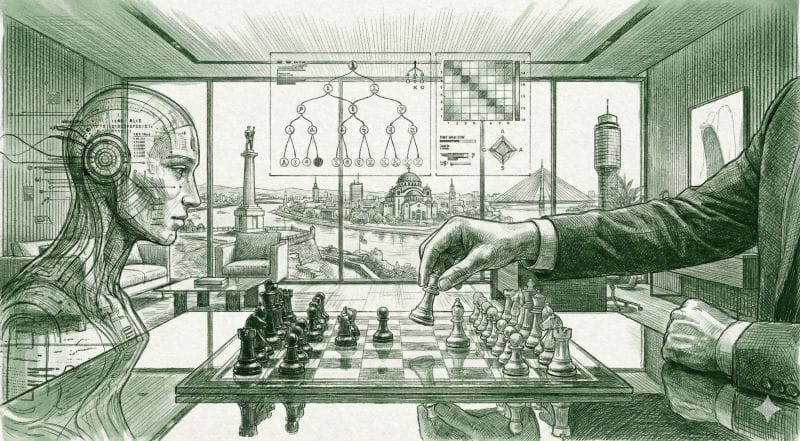

Данас се суочавамо са свеприсутном претпоставком да постоји једна посебна техника промптовања која ће откључати скривени потенцијал великих језичких модела (LLM).

RACE, RISEN, CLEAR, STAR, CARE, APE, CO-STAR, CRISPE, PEACE, IDEAL, RTF, BROKE, PCT, SCOPE, 5W1H, ReAct, TAG, GAINS, SMART, TRACE, GRADE, COSTAR-R, CREATE, CRAFT, PRIME, ALIGN, FOCUS, GUIDE, SCQA, chain-of-thought, tree-of-thought, few-shot, zero-shot, self-consistency, role prompting - списак расте готово сваког месеца.

А ви се, као неко ко жели да користи AI алате на послу, суочавате са питањем: у коју од ових техника да уложим своје време и пажњу? Одговор би могао бити истовремено једноставан и помало провокативан - чини се да, у својој суштини, све оне раде готово исту ствар.

Можда вам ово звучи као провокација, али верујем да је реч о проверљивој чињеници, која је директна последица начина на који језички модели заиста функционишу. Пре него што то детаљније разложимо, можда би требало да се суочимо са тим зашто овакав став на први поглед делује нелогично и зашто се толика интелектуална енергија троши на раздвајање техника које су, у основи, најчешће само различите варијације истог механизма.

Таксономија као замена за суштинско разумевање

За стално умножавање и раздвајање техника, разлог је вероватно психолошки колико и институционални. Када систем постане довољно сложен да измиче нашој интуицији, најлакши одговор често није дубље разумевање, већ нова класификација. Таксономија постаје замена за објашњење: измишљамо нове називе, цртамо нове дијаграме и проглашавамо суштинске разлике тамо где можда постоје само нијансе.

Када се појави нова технологија која се не понаша као софтвер на који смо навикли, наш први инстинкт је да је класификујемо кроз познате обрасце. Тада настаје читав жанр садржаја који обећава да ће вам открити „праву формулу". То је исти онај механизам који у менаџменту рађа бесконачне оквире и матрице (BSC, OKR, RACI) - сваки са својом терминологијом, али сви у суштини покушавају да реше сличан проблем координације и одговорности. Технике промптовања су, чини се, еквивалент тога у домену интеракције са језичким моделима.

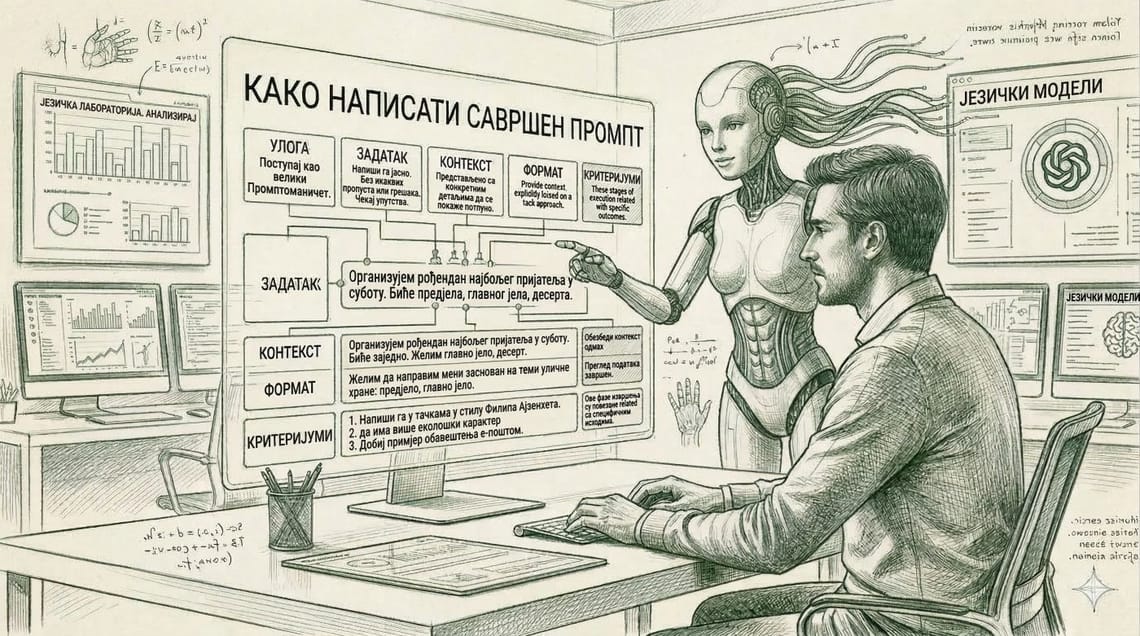

Механизам иза кулиса: Све је само продубљивање контекста

Хајде да погледамо шта ове технике промптовања заправо раде. Chain-of-thought промптовање тражи од модела да прикаже кораке размишљања пре коначног одговора. Few-shot му даје примере жељеног формата и квалитета. Role prompting поставља контекст улоге („ти си искусан правник"). Tree-of-thought генерише више паралелних путања размишљања. Self-consistency тражи више одговора па бира најчешћи.

Погледајмо како раде још неке од популарнијих техника:

RACE организује упит кроз редослед: контекст, конкретна акција, критеријуми успеха и очекивани исход. Његова снага није у „новој техници“, већ у дисциплинованом структурирању улаза који сузбија неодређеност. Модел не мисли другачије - он само добија уређенији простор вероватноћа.

RISEN додаје слој обраде: улога, улаз, кораци, очекивања и ограничења. На тај начин унапред симулира ток размишљања који желимо да видимо у одговору. У суштини, то би смо могли назвати нова кореографија истог механизма предвиђања.

CLEAR инсистира на јасноћи, логичкој повезаности и релевантности као експлицитним захтевима. Он не уводи нову способност, већ прецизира критеријуме квалитета у самом упиту. Резултат је нешто ужа дистрибуција могућих одговора.

STAR користи наративну матрицу ситуација-задатак-акција-резултат како би одговор био структуриран и мерљив. Та форма усмерава модел ка узрочно-последичној логици. Опет, није реч о новом процесу, већ пре о наметању детаљније структуре текста.

На први поглед, ово су све фундаментално различити приступи. Али ако погледамо пажљивије, чини се да свака од ових техника ради једну те исту операцију - сужава простор могућих одговора тако што моделу даје више контекста о томе шта тачно тражите и како желите да размишља.

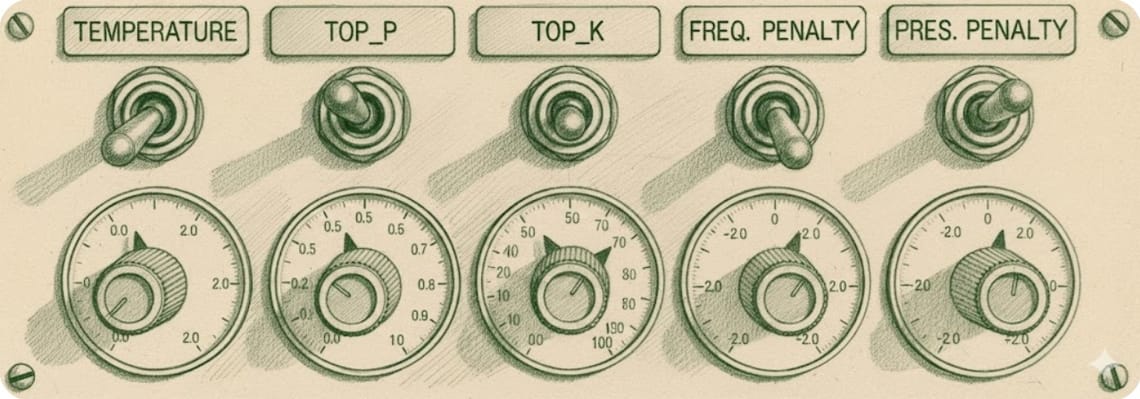

Језички модел је, у својој основи, систем за статистичко предвиђање следећег токена на основу свих претходних токена у контексту. Сваки додатни токен који му дате - било да је то пример, инструкција да размишља корак по корак или дефиниција улоге - помера дистрибуцију вероватноће следећег генерисаног токена.

Chain-of-thought не активира никакав посебан „модул за размишљање" унутар модела. Он једноставно генерише међукораке који постају део контекста, и ти међукораци померају вероватноћу коначног одговора ка тачнијем резултату.

Few-shot ради исто: примери постају контекст који сигнализира формат, тон и дубину.

Role prompting додаје опис персоне који помера дистрибуцију ка стилу одговора који је у асоцијацији са том улогом у подацима на којима је модел трениран.

Другим речима, свака техника је, на крају крајева, само другачији начин да се каже: „ево више информација о томе шта желим". Механизам је готово увек исти - проширење и обогаћивање контекста.

Јасноћа намере наспрам техничких трикова

Зашто је ово важно за вас? Зато што начин на који се технике промптовања презентују у јавном дискурсу ствара помало лажну слику сложености тамо где је суштинска динамика релативно једноставна. Када ваш тим проведе два дана бирајући између chain-of-thought и tree-of-thought приступа за интерни пројекат, то је време које није посвећено питању које заиста одређује квалитет резултата: колико прецизно разумете сопствени проблем и колико јасно то можете артикулисати.

Замислите следећу ситуацију: компанија развија интерни алат за анализу корисничких рекламација. Тим задужен за интеграцију језичког модела одлучује да користи few-shot приступ - дају моделу пет примера класификованих рекламација и очекују да настави по истом обрасцу. Резултати су осредњи. Прелазе на chain-of-thought - траже од модела да најпре анализира тон поруке, затим идентификује кључни проблем, па тек онда класификује. Резултати су нешто бољи. Тим закључује да је chain-of-thought „најбоља техника".

Али шта се заправо десило? У другом приступу, модел је добио експлицитнији опис жељеног процеса размишљања - не нужно зато што је chain-of-thought објективно бољи, већ зато што је тим, формулишући промпт, био приморан да дубље размисли о сопственом процесу класификације. Побољшање није дошло из технике. Дошло је из јасније намере и детаљнијег захтева.

Ово вероватно није само изолован случај, већ симптом ширег обрасца. Истраживања доследно указују да варијације у квалитету одговора великих језичких модела пре свега прате квалитет и прецизност улазног контекста, а знатно мање формалну структуру самог промпта.

Другим речима, пресудан је садржај и јасноћа информација које модел добија, а не шема у коју су оне упаковане. Модел који добије нејасан задатак са савршеном chain-of-thought структуром готово сигурно ће дати лошији резултат од модела који добије прецизан, детаљан задатак у слободној форми. Техника је секундарна; јасноћа је примарна.

Наравно, постоје ситуације у којима избор технике није сасвим тривијалан. Код сложених математичких проблема, експлицитно вођење кроз кораке заиста помаже - али не толико због саме технике, већ због тога што међукораци генеришу токене који држе модел „на путу" ка тачном решењу.

Код генерисања креативног садржаја, role prompting може активирати стилске обрасце из података за тренирање који су релевантни за задати контекст. Али у свим овим случајевима, техника сама по себи није довољна. Она не може да унапреди ваше размишљање, већ га само лепо технички пакује. Ако намера није јасна - ако не знате прецизно шта хоћете - ниједна техника је неће поправити.

Комуникација пре алгоритама: Укључите сопствене вијуге

Шта би ово могло да значи за праксу? Прво, можда би требало да престанемо да гледамо на промптовање као на строгу техничку дисциплину где можемо дефинисати универзалну најбољу праксу. Чини се кориснијим да га посматрамо као комуникациону вештину - способност да прецизно артикулишете захтев, дефинишете очекивани формат, наведете ограничења и дате релевантан контекст.

У српском пословном окружењу, где хијерархијски комуникациони обрасци често подразумевају имплицитна очекивања, ово може захтевати промену навика. Моделу се мора рећи све - он не „разуме" контекст који се подразумева у вашој организацији.

Друго, уложите много више времена у разумевање проблема, него у разумевање техника. Пре него што напишете промпт, покушајте да одговорите себи на питања: Шта тачно желим да добијем? Који формат је оптималан? Који ниво детаља је потребан? Који су могући начини да модел погреши и како да их предупредим? Ова припрема - која није ни chain-of-thought, ни RISEN, нити било шта са звучним именом - доноси више од било које формалне технике.

Постоји још један аспект који се ретко помиње: feedback loop (петља повратних информација). Када користите модел и добијете незадовољавајући резултат, поправљате промпт. Тај итеративни процес - прочитате резултат, идентификујeте шта недостаје, допуните контекст, покушате поново - управо је то суштина ефективног промптовања. И она је потпуно независна од било које именоване технике.

То је готово исто оно што радите када делегирате задатак колеги који вам врати непотпун извештај: појашњавате шта сте тражили, дајете конкретнији оквир, проверавате поново. Разлика је само у томе што модел не памти претходне разговоре (ван тренутне сесије) и неће вам сам рећи да не разуме питање. Зато је одговорност за прецизност и јасноћу у потпуности на вама.

Све технике промптовања су, дакле, само варијације једне једноставне идеје: дајте моделу довољно контекста да сузи простор могућих одговора на онај део који је вама користан. Форма тог контекста - да ли је то пример, корак-по-корак инструкција, дефиниција улоге или слободан опис - мање је важна.

Примарна ствар је прецизност са којом разумете шта тражите и способност да то преточите у јасан и недвосмислен текст. Модели ће се несумњиво мењати, технике ће се умножавати, али та фундаментална динамика вероватно неће.

Оно што заиста одређује квалитет резултата није алат који користите, нити техника коју примењујете - већ дубина са којом сте промислили о сопственом захтеву пре него што сте уопште поставили питање.

Повремено шаљемо мејл када имамо нешто што вреди прочитати.