Шта је заправо ЛЛМ?

Сетите се оних старих телефона са дугмићима и Т9 тастатуром, или чак данашњих паметних телефона док куцате поруку. Ви напишете „Добар“, а телефон вам одмах понуди „дан“. Напишете „Видимо“, он нуди „се“. То је статистика у свом најједноставнијем облику: уређај је запамтио да после речи „Добар“ најчешће следи „дан“. Он не размишља о временским приликама нити о вашем расположењу; он само израчунава вероватноћу наредне речи.

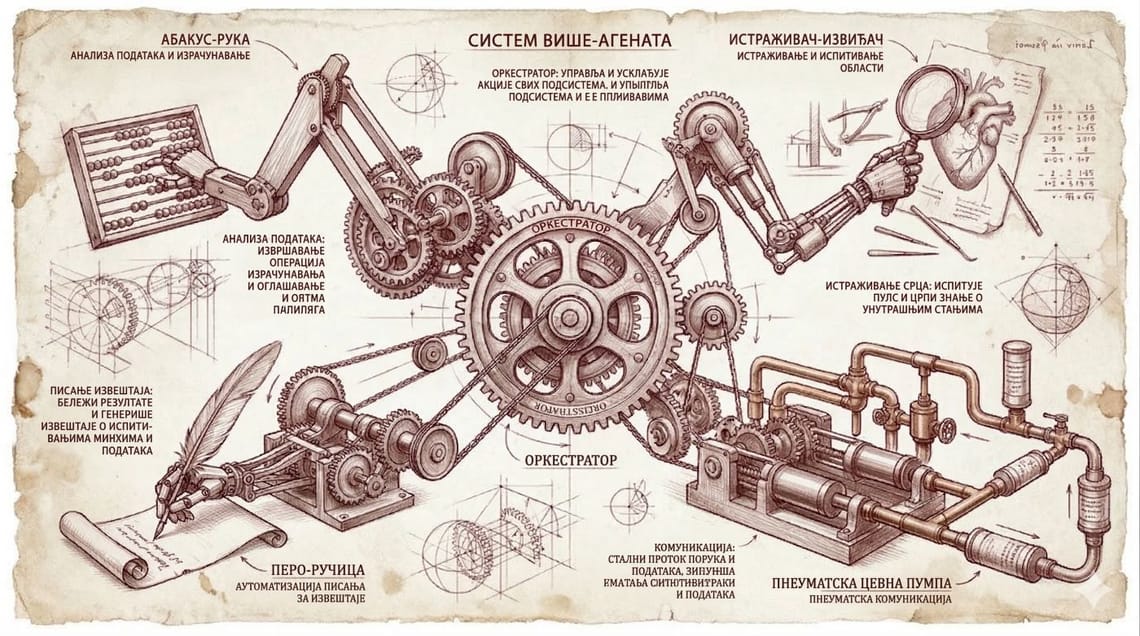

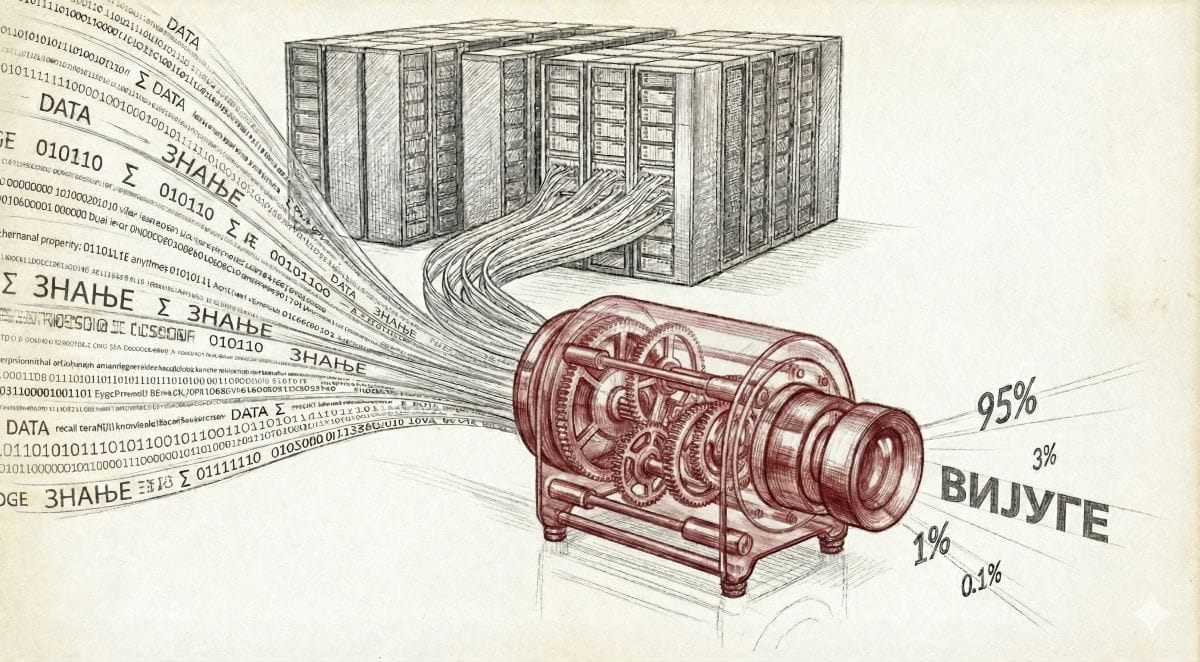

Хајде да замислимо тај исти механизам, али унапређен до незамисливих размера. Замислите систем који није прочитао само ваше кратке поруке, већ готово цео дигитализовани свет: књиге, научне радове, форуме, YouTube видео записе, па чак и све оне рецепте за ајвар објављене на интернету. То је, у својој суштини, Велики језички модел (Large Language Model - LLM).

Када чујемо акрониме попут LLM-а, или имена као што су GPT, Claude или Llama, често замишљамо дигитални мозак који „зна“ ствари. Међутим, LLM није база знања. То није Google претрага са полицама пуним чињеница. LLM је, заправо, невероватно сложен калкулатор вероватноће.

Он не „познаје“ лик и дело Николе Тесле на начин на који га ми разумемо - као историјску личност од крви и меса. За један модел, „Никола Тесла“ је само низ токена који се статистички појављује у непосредној близини речи „струја“, „наизменична“, „Смиљан“ и „голуб“. Уз то, LLM не живи у нашем „сада“. Његово разумевање света престаје оног тренутка када је завршен процес његовог тренинга, што га чини својеврсном временском капсулом наше колективне прошлости.

Када му поставите питање, он не трага за истином, већ за следећом речју. Он предвиђа шта би највероватније требало да следи, реч по реч, на основу милијарди образаца. То је налик папагају који је преслушао све разговоре на свету: ако га питате за медицински савет, он ће звучати као лекар јер је научио редослед речи који лекари користе. Ипак, он нема суштинску представу о томе шта је јетра, нити шта заиста значи бол.

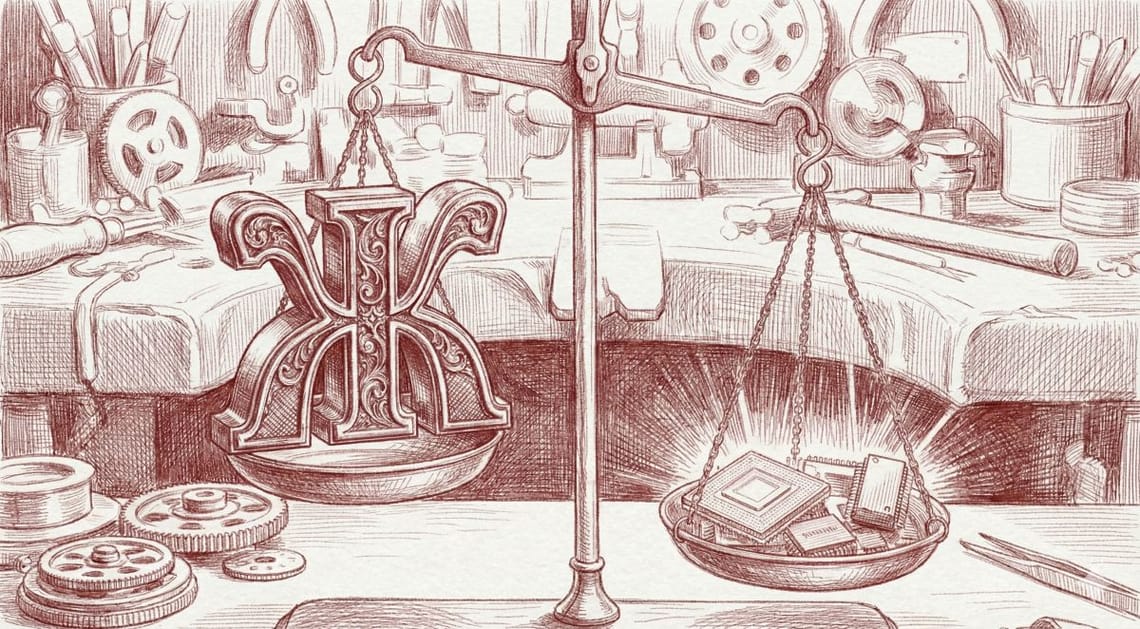

Ово раздвајање појмова, разумевање насупрот предвиђању, кључно је за трезвено сагледавање ствари. Код нас се често каже да неко „лепо прича, ал’ ништа не каже“. LLM је можда најубедљивији пример те изреке. Његова граматика је беспрекорна, стил течан, а „прича“ одише самопоуздањем.

Међутим, пошто му је примарни циљ да реченица звучи уверљиво, а не нужно да буде чињенично тачна, он је склон ономе што стручњаци називају „халуцинацијом“. Ми бисмо то народски рекли - лупетање.

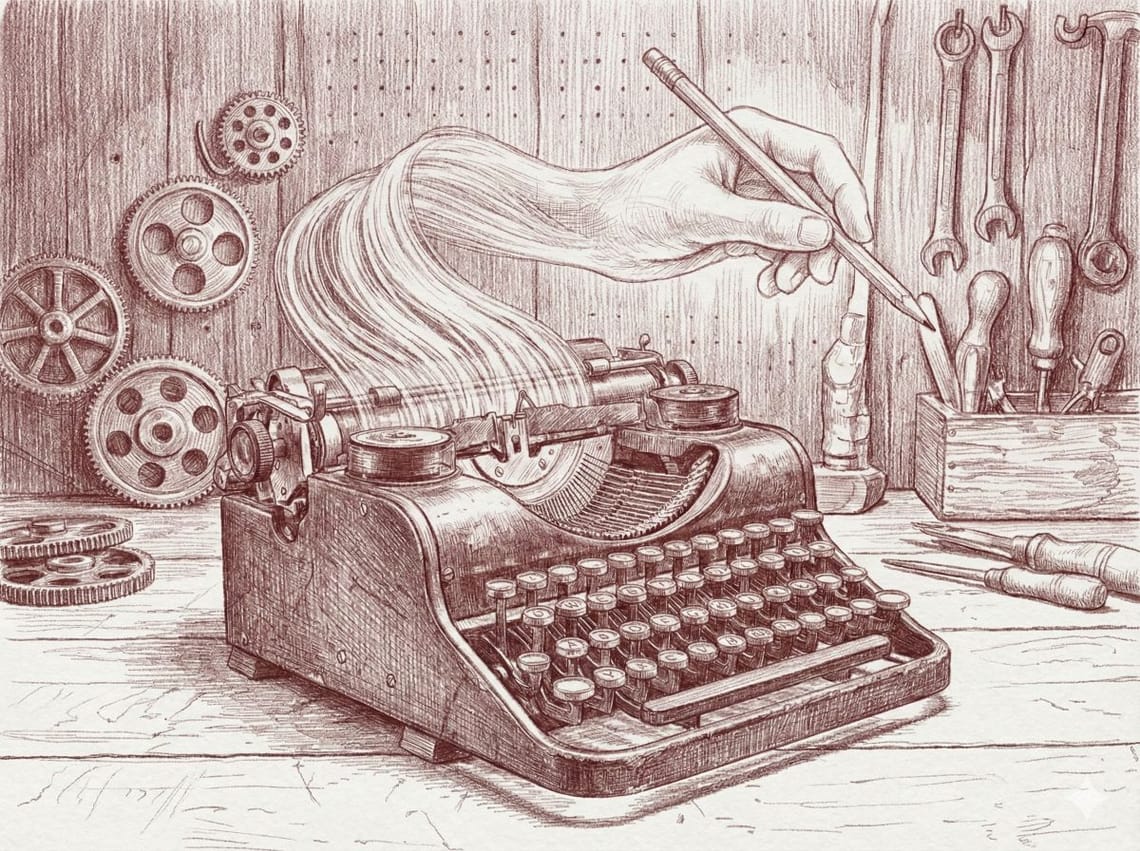

Зашто се онда јавља толико одушевљење око ових модела? Вероватно зато што се испоставило да „само предвиђање следеће речи“, када се спроведе на довољно великом узорку, почиње да наликује размишљању. Модел може да сумира уговор, програмира, преформулише текст или напише песму јер препознаје обрасце.

А људски језик, па можда и само људско мишљење, у великој мери јесте сачињено од образаца. Ипак, морамо бити свесни да, као својеврсни микс нашег језика, LLM неминовно наслеђује и наше предрасуде. Он је огледало које подједнако јасно рефлектује и наше знање и наше дубоко усађене заблуде.

Овде долазимо до закључка да LLM није нека научна фантастика, нити је свесно биће које размишља. То је математичка функција која је потпуно пасивна док је ми не покренемо. Он је алат који чека наш импулс, наше питање, да би уопште почео да ради.

Већина текстуалних задатака који се појављују у пословном окружењу јесте понављање обрасца. Већина мејлова, извештаја, презентација, интерних комуникација стално прати исте шаблоне. Људи те шаблоне извршавају на основу разумевања, али често би их могли извршавати и на основу обрасца.

Зато модел може да изгледа компетентно: није да је научио посао, него је посао заправо био мање интелектуално захтеван него што смо мислили, и то није критика модела, већ увид у природу посла.

Ово сазнање мења начин на који гледамо на његову примену. Ако прихватимо да је LLM „креатор текста“, а не „непогрешиви извор истине“, престаћемо да га питамо за прецизне датуме или тренутни девизни курс. Уместо тога, користићемо га за оно у чему је изврстан: сажимање, стилизовање, форму, структуру и давање идеја.

Такође, са овим сазнањем уклањамо стално помињани страх од тренутне замене људи машинама. Оне могу заменити механички део писања и убрзати израду нацрта, али оне немају намеру, немају додир са стварним светом и, што је најважније, немају одговорност. LLM може написати извињење клијенту, али не може осетити тежину тог чина, нити проценити када је разговор телефоном ипак боље решење.

Када следећи пут отворите неки чет-бот (ChatGPT, Gemini, Claude, Grok, Kimi, DeepSeek) који користи LLM да би уопште могао да ради, не гледајте у њега као у машину која има све одговоре на ваша питања. Посматрајте га као огледало нашег колективног језика.

Све што он напише јесте сублимација онога што смо ми већ написали. То је моћна и револуционарна технологија, али је и даље само алат у рукама човека који зна шта жели да каже - чак и када му је потребан мали статистички подстицај да пронађе праву реч.

Питања за размишљање:

- Ко ће бити одговоран када модел да одговор који је технички коректан, али суштински погрешан?

- Да ли људи који ће користити модел имају довољно знања да препознају када је одговор нетачан, или, још горе, полу-тачан?

- Како ћете знати да ли систем ради добро, или вам се само чини да ради добро?

Повремено шаљемо мејл када имамо нешто што вреди прочитати.