Преговарање са вероватноћом: Зашто синтакса није суштина AI револуције

Последњих годину дана сведочимо великом таласу „експертских“ курсева који обећавају да ће вас за неколико недеља претворити у сертификованог промпт инжењера. Маркетинг је јасан: постоји тајна формула, постоје скривене структуре реченица, постоје прецизна правила која, ако их савладате, гарантују контролу над великим језичким моделом (LLM).

Око ове идеје се гради читава мини-индустрија: вебинари, шаблони, чек-листе, „напредни“ трикови. Међутим, основну претпоставку на којој све то почива ретко ко доводи у питање: да ли је могуће увести строгу методологију у систем који по својој природи није детерминистички?

Испод те површине, испод сјајних сертификата који обећавају магичне резултате, лежи фундаментална заблуда. Оно што називамо „инжењерингом“ у овом контексту ретко поседује карактеристике инжењерске дисциплине - предвидљивост, поновљивост и јасну узрочно-последичну везу. Уместо изградње мостова по законима физике, ми се овде бавимо преговарањем са статистичком вероватноћом.

Када видите менаџера који сатима преправља један те исти промпт да би од машине добио „савршен“ извештај, то није програмирање система. То је покушај да се случајност контролише речима. То више личи на погађање шта ће упалити, него на прецизну науку, плус је све упаковано у ауторитативне изразе.

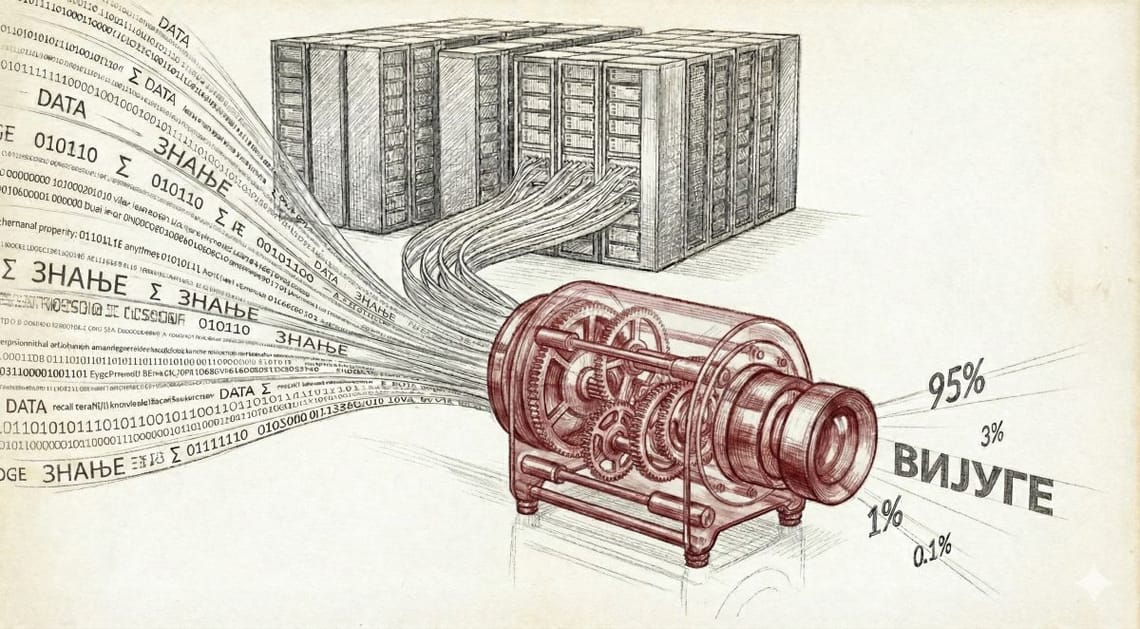

Проблем настаје оног тренутка када поверујемо да је синтакса суштина. Убеђење да постоји „права реченица“ која, ако се правилно напише, отвара неслућене капацитете модела, заправо је одраз наше људске потребе за детерминизмом. Ако сте три пута добили добар резултат користећи фразу „понашај се као експерт“, ваш мозак ће усвојити правило. Али, модел не „разуме“ концепт експерта на начин на који ми то разумемо, нити поштује наша правила на начин на који то ради традиционални софтвер.

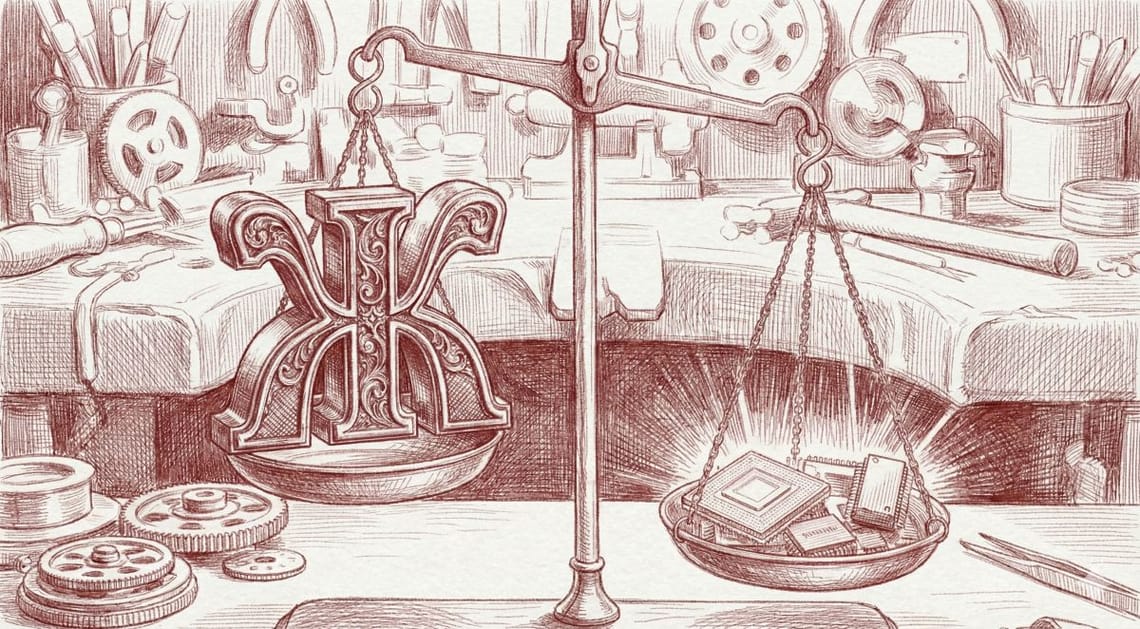

Ова разлика није семантичка, она је оперативна и стратешка. Када организација уложи ресурсе у обуку запослених да упамте специфичне фразе или комплексна упутства, она је промашила циљ. Модели се мењају. Оно што је функционисало на претходној архитектури може бити потпуно сувишно или чак контрапродуктивно на неком будућем моделу.

Технике које данас учимо као „напредне стратегије за писање промптова“ заправо су само привремене закрпе за тренутна ограничења технологије. То нису трајне вештине; то су помагала. Фокусирањем на њих, ми запослене учимо како да заобилазе проблем, а не како да га структурирају.

Симулација продуктивности уместо стварне вредности

Погледајмо ово кроз призму економије рада и организационе културе. У многим домаћим фирмама, где је култура често усмерена на форму уместо на суштину, писање километарских упита постаје савршен алат за симулацију продуктивности. Лакше је провести два сата „оптимизујући промпт“ него провести два сата прикупљајући валидне и прецизне податке или дефинишући стварне пословне захтеве.

Ово ствара опасну повратну спрегу. Запослени се осећају продуктивно јер „комуницирају са AI-јем“, менаџмент је задовољан јер се „имплементирају нове технологије“, а стварна вредност - квалитетна одлука или решен проблем - остаје у другом плану. Имамо ситуацију где се више времена троши на формулисање питања него на критичку анализу одговора.

Размотримо конкретан пример из праксе. Замислите финансијског аналитичара који користи комплексни вишестепени шаблон за промпт да би добио процену ризика за одређену инвестицију. Он пажљиво саставља упит, тражи од модела да прво анализира макроекономске факторе, затим специфичности индустрије, ограничава врсте ризика и на крају да синтетише закључак. Модел избаци импресиван, логички структуриран текст. Аналитичар је задовољан јер је добио резултат који делује ауторитативно.

Међутим, овде лежи системски ризик: кохерентност није исто што и тачност. Модел може савршено симулирати процес резоновања, пратећи све кораке које сте му задали, а да притом оперише потпуно измишљеним подацима или погрешним претпоставкама. Форма је задовољена, али је пословни резултат потенцијално катастрофалан јер је фокус био на томе како питамо, а не шта модел заправо зна.

Права истина, коју ретко чујете на курсевима и семинарима, јесте да је већина „инжењеринга упита“ заправо компензација за лошу комуникацију или недостатак контекста од стране човека. Ако морате да напишете три странице инструкција да би модел урадио оно што желите, вероватно проблем није у моделу, већ у томе што задатак није јасно дефинисан.

У традиционалном инжењерству, ако систем захтева да корисник унесе шифру тачно под углом од 37 степени да би функционисао, то називамо лошим дизајном, а не „напредном корисничком вештином“. Међутим, у свету вештачке интелигенције, ми смо управо ту ману брендирали као вештину.

Психологија контроле и права стручност

Постоји и психолошки аспект ове опсесије. Људи воле ритуале. Воле осећај да поседују тајно знање које им даје моћ над машином. Али реалност је другачија. Ми често тражимо узрочност тамо где постоји само корелација или чиста случајност.

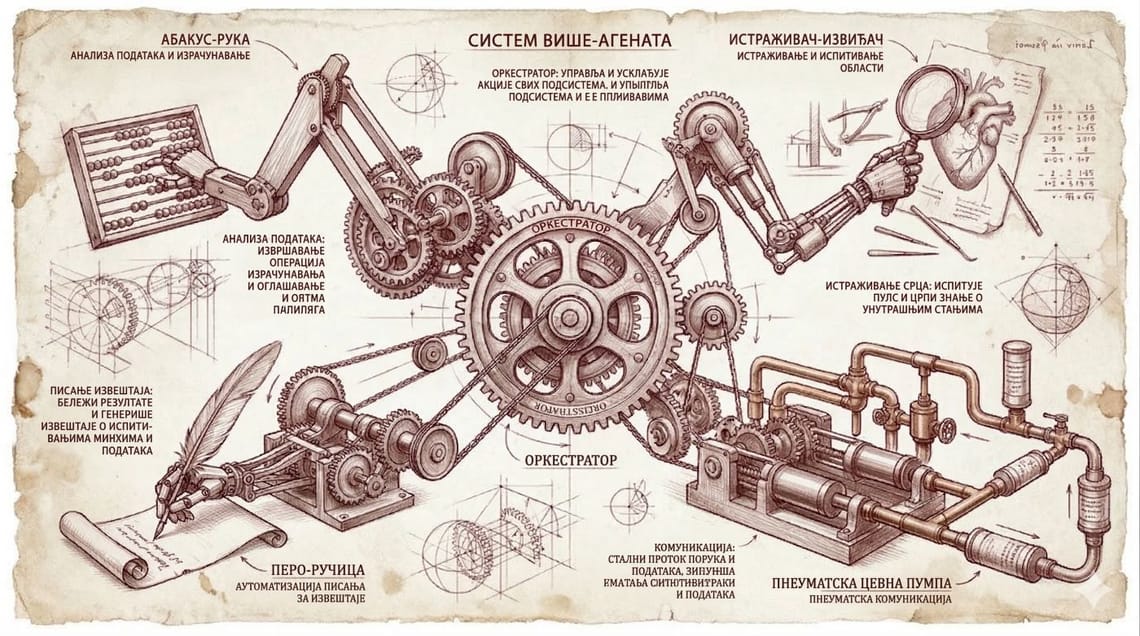

Оно што заиста раздваја успешну примену од аматеризма није познавање трикова, већ доменско знање и способност системског размишљања. Прави инжењеринг у овом домену није слагање речи, већ архитектура информација. Које податке дајемо моделу? Да ли смо му дали довољно контекста о нашем пословању? Да ли смо дефинисали тон нашег бренда и обезбедили историјске податке компаније?

Прави професионалац неће трошити време на смишљање савршених придева у инструкцији. Он ће се фокусирати на то да моделу достави конкретне узорке, јасне спецификације и недвосмислена ограничења. Први приступ је уметност погађања, а други је стварно управљање контекстом.

Повратак основама: Шта заиста треба да учимо?

Ово нас доводи до кључног питања за лидере и менаџере: Шта онда треба да учимо наше запослене? Ако не учимо људе промптовању, шта градимо као компетенцију?

Одговор лежи у повратку на основе које смо у овој технолошкој грозници запоставили. Способност декомпозиције комплексног проблема на мање, логичке целине далеко је вреднија од познавања синтаксе.

Друга кључна компетенција је евалуација - способност критичке процене одговора постаје најскупљи ресурс. Уместо да учимо људе како да генеришу текст, треба да их учимо како да га исправљају, како да провере чињенице и како да препознају логичке грешке. Врхунски корисник AI алата није онај који најбоље даје инструкције алгоритмима, већ онај који има најразвијенији имунитет на бесмислице које алгоритми могу да произведу са великим самопоуздањем.

Постоји и димензија одговорности. Када се превише ослањамо на комплексност упита, ми суптилно пребацујемо одговорност на алат. „Питао сам га на прави начин, али је погрешио“ постаје валидан изговор. Ово је опасно. Ако Ексел избаци погрешан резултат јер сте унели лошу формулу, нико не криви софтвер, криве вас. Исто мора важити и овде.

Стварна моћ не лежи у томе како се обраћате машини, већ у томе колико добро разумете проблем који покушавате да решите уз помоћ те машине. Ако ваши људи не знају критички да размишљају, AI ће их претворити у пасивне посматраче сопственог посла.

Неопходна је суштинска промена мишљења: уместо усавршавања промптова, треба градити системе и процесе. Прави корисници AI технологије нису они који познају најбоље формулације, већ они који јасно разумеју своје потребе и препознају када их вештачка интелигенција одводи у погрешном смеру. Све остало је само тактика са роком трајања до следеће верзије AI модела.

Повремено шаљемо мејл када имамо нешто што вреди прочитати.